为了防止AI偷图,我在画里“下了毒”|甲子光年

“对我们充满恶意的,不是AI研究者,而是那些Pro AI但并不太懂的人”。

作者|田思奇

编辑|王博

求救的信号来得很快。

伴随着AI创作的画作《太空歌剧院》在2022年8月一举夺得艺术比赛冠军,AI绘画在ChatGPT发布前掀起当时最火爆的生成式AI浪潮。

但金·范·德恩(Kim van deun)感到了前所未有的不安。

作为一位艺术创作者,他自然不希望AI模型未获授权就拿走自己具有独特风格的作品去训练。但谁能来保护自己呢?

他立刻想到了曾经反抗AI肆意抓取网络人脸数据的芝加哥大学研究团队。该团队曾在2017年推出Fawkes防护工具抵制非法人脸识别——这个名字来自戴着白色微笑面具的英国反叛者盖伊·福克斯(Guy Fawkes)。

5年后,该团队的负责人之一单思雄(Shawn Shan)已经从芝加哥大学的计算机系本科生升为博士生。一直沉浸在AI安全与隐私领域的单思雄,在金·范·德恩的引领下,走入了艺术家的世界,感受到了他们对现状不满的呼声。

为什么不开发一款可以从AI模型“手中”保护艺术作品的工具呢?

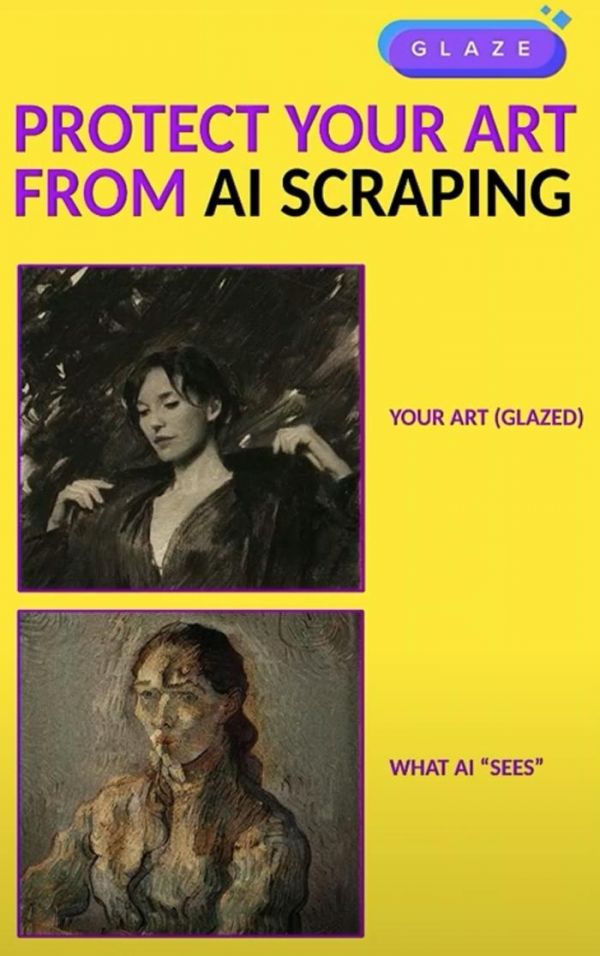

2023年3月,单思雄所在团队开发的Glaze免费上线,迄今为止下载量超过260万。Glaze可以阻止AI模型学到艺术作品的特定风格。其名称的中文是“上釉”,相当于为画作添加一层保护膜。

然而它引发了巨大的网络舆论反弹。邮件、Reddit和Twitter上充斥着批评的声音,称它会阻挡AI行业的创新,或者嘲讽它很快就会被破解。

“如果他们的创新要牺牲别人的饭碗,那当然可以阻挡,”单思雄回应道,至于那些意料之中的恶意,“他们越愤怒,越在乎,意味着我们成功的概率就越高。”

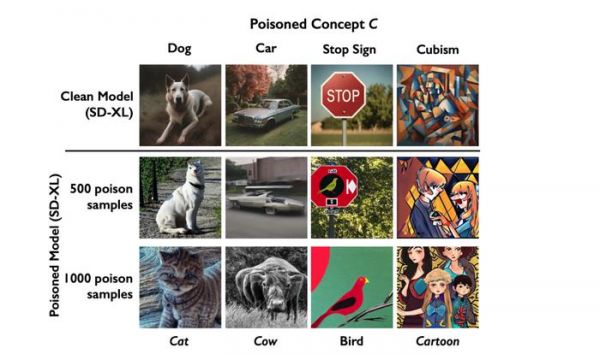

2024年4月,优化了效果和速度的Glaze 2.0及其网页版也顺利发布,但该实验室想做的还不仅如此。他们在今年2月就推出了另一个更具有攻击性的数据投毒(data poisoning)工具——Nightshade,它可诱导偷拿数据的AI模型训练出截然不同的错误结果。

简单来说,只要通过Nightshade修改足够多的像素点,一幅肉眼看起来是“狗”的照片,可能已经被AI学习为“猫”,导致输出的结果“猫狗不分”。相关论文已在今年5月发表于信息安全领域的顶级会议之一IEEE S&P。

Nightshade的名字取自能开出紫色小花的茄科植物。它带有微弱毒性,只有大量服用才会出现中毒症状,“我认为这符合我们工具的特性,” 单思雄说道。在4个月内下载量突破50万后,Nightshade正成为艺术家手中的利器。

身为95后,单思雄与“不道德AI”的斗争已持续7年之久。他不断强调自己希望AI能发展得更好,但在完善的监管措施出台之前,他可能还会继续为视频、音频等多种作品形式开发类似的防护工具。

他似乎总是在回避当下非常有利润前景的那些方向。用他的话来说,这样的选择“或许是有一些叛逆在里面”,更重要的是,“我对‘对与错’的重视要比对金钱的重视要高一些。”单思雄说。

本文,「甲子光年」独家对话AI数据投毒工具Nightshade主创之一、芝加哥大学博士生单思雄。

单思雄,图片来源:受访者提供

单思雄,图片来源:受访者提供1.像素级的隐秘防线

甲子光年:如果一位艺术家来找你寻求帮助,你会如何解释Glaze和Nightshade的技术原理?

单思雄:人类与AI看画的方式很不一样。人类通常是通过观察线条、色彩等视觉元素来感知艺术作品,而AI是基于纯数学的方式进行分析。人类在观看时不会关注到每一个像素的细节,但计算机会读取每个像素。即使是肉眼看来微小的改动,也可能对AI的理解造成显著影响。

例如,梵高的画作经过这些微调后,可能被AI误理解为当代艺术作品,导致AI模型无法准确学习梵高的绘画风格,从而实现对原作艺术风格的保护。大多数小改动对AI的影响可能并不显著,但通过不断尝试,我们可以进行数百万次的实验,找到对AI影响最大的变化。

甲子光年:感觉Glaze是防御工具,而Nightshade更像是一种攻击工具?

单思雄:Glaze的设计理念是专注于保护艺术家自己的作品,它的自我保护能力是最强的。而Nightshade不同,它不仅保护自己,还试图影响整个模型,因此它的攻击性更强。但这种全面攻击的特性也意味着它在自我保护方面可能会有不足。

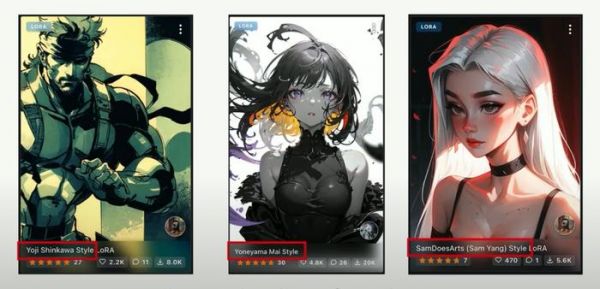

站在艺术家的角度来看,对于刚入行的新人或者学生来说,用Glaze更合适,因为它主要帮助他们保护自己的艺术作品。对于那些已经小有名气的艺术家,如果他们不太担心自己的作品被用于AI训练,或者作品已经被纳入训练集了,他们可以考虑使用Nightshade这样的攻击性工具。从公司的视角出发,像迪士尼这样拥有大量版权的公司,他们的作品很可能已经被AI模型学习过了,所以他们对Nightshade这种攻击性工具更感兴趣。

甲子光年:我们知道,图片上传再下载就会有大幅压缩,被改变的像素点可能都没有了,这是否意味着保护也没有了?

单思雄:我们测试过图像压缩的影响,因为压缩确实很常见。但我们发现压缩对保护效果的影响相对较小。如果压缩导致图像质量极低,变得模糊,那么保护会去除得更明显,但它被用来训练AI模型的效果也会很差。从这个角度来看,保护仍然是成功的。

甲子光年:有个比喻说想要去除Glaze的效果,相当于你已经把毒药投到一杯水里溶解,现在要想把毒性从这杯毒水里完全去除,是非常困难的。

单思雄:对,大概是这样。

甲子光年:你们认为Glaze和Nightshade的局限是什么?

单思雄:在我们最初开发时,主要用梵高、莫奈这样的艺术作品进行测试,效果都不错。但后来我们发现,对于一些风格较为平整、没有太多纹理的漫画作品,保护效果就差了很多。

甲子光年:漫画的保护效果不好,是因为要保证肉眼看到的效果差不多,改变的像素点会比较少。对于这种特定类型的绘画作品,工具的效果就会弱一些,或者说牺牲质量会多一些。

单思雄:如果你对数值进行相同的改动,在漫画上肉眼看到的变化会更明显。不过我们也找到了其他的改动方法,比如微调线条的位置,把线条整体向右移动一个像素。虽然从数学角度来看变化很大,但对人眼来说,这种变化几乎察觉不到。Glaze 2.0版本对于没有纹理的图画保护也比以前进步了很多。

甲子光年:还有很多人反馈操作一张图的时间太慢了。

单思雄:如果是没有GPU的话,可能一张图确实需要20-30分钟,一些很老的CPU上可能需要一个小时。但是我们现在与公司合作,提供了服务器服务。艺术家可以注册账户,使用我们的GPU来处理,完成后会再通过邮件发给他们。

甲子光年:除了图像方面,在视频和文字方面也会想做类似的工具吗?

单思雄:文字的处理确实比较棘手,因为与图片不同,图片由许多像素组成,我们可以只改变其中一小部分。另外对于文字作品,即便是知名作者,也很难形成自己独特的风格,也不好判断是否被用于训练了。

我们目前有个项目专注于视频内容的保护,确保视频不会被AI模型学习。视频本质上也是由一帧一帧的图片也就是像素点组成,只是数量更多。但视频中有很多帧看起来非常相似,这就很容易通过对比分析找出差异,并清除特定区域的改变。为了增加清洗难度,我们也在开发一种新的技术。

甲子光年:如果要对作品形成保护,其实把作品放在平台的付费墙内也行?

单思雄:现在很多艺术家只能这样采取一些折中的方法,比如公开展示低分辨率的作品,而把高质量的高分辨率作品留起来。毕竟他们还是需要让人看到自己的作品才能吸引关注和工作机会。

但现在这种做法也有风险,因为即使是低分辨率的图片,AI也能通过算法提升至高分辨率,意味着无论艺术家如何展示作品,都难以完全避免作品被AI抓取用于训练,尤其是对于那些名气不大的新艺术家来说,既要让自己的作品不被轻易发现,同时又要展示自己的才华是很难的。

甲子光年:目前有和作品平台的合作吗?

单思雄:感兴趣的平台很多,但是我们还是比较小心一点,因为我们要把代码给他们。我们已经和(艺术社区)Cara合作过,艺术家把作品发到那个网站上时可以勾选我要保护这张图,那就会自动在公司层面完成。我们比较信任Cara,跟它的创始人合作很多,他不会跟那些Pro AI(支持AI)的人有联系。别的平台就不太相信,我们还是比较保守的。

2.键盘上的恶意

甲子光年:试想一种情况,我是一位艺术家,能用上Glaze和Nightshade当然很好。但这意味着我必须花很多时间和精力主动保护我的作品,负担比较重。而我本来可以依靠外部法律和监管环境来帮我。你怎么看?

单思雄:我希望目前的工作只是一个开始。至少在欧美,人们正在积极探讨如何通过法律法规来保护艺术家,因为即使在AI技术出现之前,就已经有多种技术手段用于保护版权。我相信现在依然需要计算机专业人士的参与和帮助,我也希望能有更多法律手段来为艺术家提供保护。

但我也不是特别看好这方面。无论是在国内还是欧美,AI的发展都受到极大的重视,很难从保护艺术家的角度出发来阻止AI技术的快速发展。

一些AI绘画软件可以选择生成特定艺术家的风格

甲子光年:所以你也会认同你们所打造的这些工具,只能起到短期的保护作用?长期还是要靠监管立法。

单思雄:这是一定的,不可能就靠我们几个AI安全实验室去跟OpenAI和微软进行真正长期的较量。但我们现在可以暂时阻止他们一段时间,等待或者迫使相应的法律法规出来。

长远来看,法律法规可能主要影响的是大型公司。对于个人黑客来说,他们想要抄袭作品也很难被现有法规限制。这方面我希望我们的工作能够持续发挥效果。

甲子光年:Glaze可能还好,但是Nightshade属于数据投毒行为,有些人认为这是有伦理争议的,而且也会阻挡AI的创新。

单思雄:如果他们的创新要牺牲别人的饭碗,那当然可以阻挡。如果AI公司能够通过合法途径获取艺术家授权,支付报酬,或者从公司购买版权,那么这并不会对它们造成任何负面影响。问题在于,一些公司选择走捷径,影响了艺术家的收入。

甲子光年:这些公司就好像是无论如何我先拿来用了,你到时候再找我解决版权纠纷好了。

单思雄:我们在保护自己的艺术,如果你拿来用,没有经过我的同意,你中毒了也跟我没关系,对不对?

甲子光年:但是对于更广义的数据投毒,比如在自动驾驶系统上出现数据投毒,它会对人身安全构成威胁。

单思雄:在AI安全领域,针对数据投毒的研究已经存在很多年了,至少从2017年就开始了。我们也会研究如何保证自动驾驶模型不受数据投毒的影响。但自动驾驶的数据主要来自内部或购买的路况信息,真正的数据投毒问题可能在于其他方面。

甲子光年:你们一直保持非营利的免费运行模式,是不是为了规避潜在的伦理风险?

单思雄:确实有这样的考虑,但主要还是出于支持艺术家的角度。在AI出现之前,艺术家就面临着赚钱难、资源有限的问题,我们不会再想从他们身上赚钱,这样做也能提高我们的可信度。之前一些App声称可以帮助艺术家保护作品,或者与AI公司协商不要拿作品训练,但后来发现这些都是假的,作品还是被用于训练模型了。我们从完全免费的角度出发,会更有说服力。

甲子光年:你们的资金成本大概是多少?

单思雄:我们导师和整个实验室在AI安全领域发表了大量论文,这些都是我们正常工作的一部分。

甲子光年:所以就是把研究过程中的一些成果免费公开了。但好像也有很多风投找过你们?

单思雄:非常多,但我们把他们都拒绝了。

甲子光年:为什么要拒绝他们?

单思雄:风投介入对我们的影响会很大,因为他们的主要目的是盈利,我们也不可能一直提供免费服务了。他们对我们的许多决策也会有影响,我们的初衷还是从研究和保护艺术家的角度出发。

甲子光年:不过Webglaze(Glaze的网页版)是用了亚马逊AWS的研究基金做的?

单思雄:那个是很久以前拿到的,对我们也没有约束,只要把钱用在研究上就可以。现在那个基金也到期用完了。目前我们主要依靠实验室的正常研究拨款来运作。

甲子光年:你们从来没想过这些工具的商业模式应该是什么吗?

单思雄:从来没有。但我们可能会想和大公司合作,这些公司可能会提供一些资源支持,不一定是资金。这样可以提高我们的可信度,并扩大我们的影响力。

甲子光年:你从2017年开始进入这个领域,这七年里有没有遇到比较大的挑战,或者感觉很迷茫困惑的时候?

单思雄:整体还好,但有段时间我对AI保护的效果不满意,低迷了很长时间。Glaze出来以后压力又很大,经常有人说把我们破解了。我们之前与艺术家们进行了深入的交流,还向他们保证我们的技术一定能够成功,因此他们也给予了我们很多支持。万一发布没两天,我们的保护效果就被别人清洗掉了,压力就很大。

甲子光年:等于没有发布的时候感觉没做出什么东西,做出来了又担心效果不好。

单思雄:如果是普通的学术论文发表,可能也不会有太多人关注我们。但现在我们感觉更面向大众,很多人对我们的工作持反对态度,这也是我们预料之中的。一开始我们导师经常在Twitter上回应,压力非常大。后来很多艺术家在使用后觉得效果不错,也会帮我辟谣。

甲子光年:这些对你们充满恶意的是什么人?是你说的Pro AI的人,AI研究者?

单思雄:AI研究者并不多,主要是一些Pro AI但并不太懂的人,不是真正从事AI开发的人。大公司的人不会直接攻击我们,因为这会涉及法律问题,他们不会直接发邮件表达不满。但在Reddit上,有些人认为我们的工作不好,就会批评我们。

甲子光年:这种“键盘上的恶意”都在表达什么意思?

单思雄:就说我们让AI研发停滞了,以及我们这个根本行不通。

甲子光年:那他们的逻辑就不合理。如果你们做的东西行不通,其实对他在意的事情就不会构成威胁了。

单思雄:所以我们自己的理解也是,他们越愤怒,越在乎,我们成功的概率就越高。

3.站在Pro AI的对立面

甲子光年:你们团队的构成是怎样的?

单思雄:我算是Co-Lead,就是负责人之一,几篇论文的一作一般是我。写代码主要是我和四五位学弟学妹在做,另外有两位学姐已经毕业了。还有我的两位导师(赵燕斌教授和郑海涛教授)会提供很多资源,对我们有很多指导,包括怎么和公司合作来保护,也都是导师来决定。

(注:单思雄和已经毕业的Jenna Cryan, Emily Wenger凭借Glaze的成果共同入选2024福布斯北美U30榜单)

甲子光年:你打算博士毕业后做什么?

单思雄:我可能明年这个时候毕业,应该会找教职。

甲子光年:不会考虑投身业界吗?

单思雄:确实有可能,但也可能做一些咨询工作,核心还是继续推动这个领域的研究。

甲子光年:你是上高中的时候就很确定想来芝加哥大学读本科,学习计算机相关专业吗?

单思雄:当时在早申阶段申请了芝加哥大学,也没觉得自己肯定能被录取,不过还是很惊喜真的录了我,我也就没申请别的学校。专业当时还没太想好,其实挺想做环境保护这方面。来到芝加哥以后选修了一节计算机的课,那位教授特别好,让我开始对这方面感兴趣,所以就学了这个专业。

甲子光年:芝加哥大学就是在你刚上本科的时候大力发展计算机系了吧,挖来了很多人。

单思雄:对,我刚开始读的时候计算机系可能只有20位教授,而且都是比较年长的,做理论相关的教授。后来请到了原来加州大学伯克利分校的计算机系主任Michael Franklin做我们的系主任,发展到现在系里有60多位教授了,各方面资金很充裕,我也算比较幸运。

(注:单思雄的两位导师赵燕斌教授和郑海涛教授在2017年从加州大学圣芭芭拉分校跳槽至芝加哥大学,共同领导SAND实验室)

甲子光年:你在计算机领域内从事AI安全相关的研究,是因为刚好加入了赵教授和郑教授的实验室才做,还是对这方面感兴趣?

单思雄:我一直都对这类保护比较感兴趣,我发的论文不管是不是和赵老师合作,都是以保护为主。

甲子光年:你最早想学的环境科学,其实也是一种“保护”性质的专业。这算是“叛逆”的选择吗?你好像一直都不想做当下非常有利润的领域。

单思雄:是有一些叛逆在里面,主要我还是对“对与错”的重视要比对金钱的重视高一些。

甲子光年:你会用“对与错”这样是非分明的描述,所以你觉得当下主流的AI研究方向是错的。

单思雄:不能说是错的。从美国这个资本主义国家的角度来说,可以赚钱的模式当然要大力发展,公司角度也是如此。当微软发展很好,谷歌有点落后的时候,谷歌压力就很大。他们不可能不要经济价值,一味地去保护艺术,我没觉得他们做错了什么。只是现在的形势发展,让我不希望继续往这个方向走,我希望我的研究成果可以强制他们转向更符合道德的角度。

甲子光年:在主流业界大公司里,还会有你比较欣赏或者想一起共事的榜样吗?

单思雄:还是有很多的,比如Ed,他之前是Stability的VP,但是辞职了。他说其实很多真正下面做事情的人都不太同意公司的做法。所以我也相信很多人知道不应该是这样,但现实在压迫他们继续。现在无论是在公司还是业界,已经出现越来越多的警告,未来还会有更多人站出来说自己在公司内看到的不好的事情,这样就会迫使法律保护创作者。

(注:2023月11月,Stability负责音频的副总裁Ed Newton-Rex辞职,因为他认为使用受版权保护的内容开发AI模型是不合法的。)

甲子光年:从事AI安全,抵制AI挪用作品去训练的研究,会让你把自己定义为一个反AI的人吗?

单思雄:我觉得不是。我们之前做的很多研究都是在保护AI模型,让它不会被投毒,被扰动攻击。我还是想让AI更好。但现在这种直接拿数据没版权的训练模式我觉得是不对的。短期来说它可能让AI发展更快,长期来看对AI没有好结果。我希望自己或者别人的研究可以让AI走上正轨,正式获得一些版权。

甲子光年:但你刚刚提到你们不想合作和接触的就是“Pro AI”的人,你已经站到他们的对立面了?

单思雄:我指的是Pro现在生成式AI模型的一些人。他们的角度是以盈利为目的,任何牺牲都可以接受。可是已经有很多研究证明AI不能在自己生成出来的数据上训练,否则模型会出问题。但现在大力开发AI模型,要是让所有艺术家和创作者都失业,没有人去学了,长期肯定会对AI造成影响。AI的发展仍然需要很多人为的新作品、新创作。

甲子光年:所以你是更多的希望鼓励人类去创作。

单思雄:也是鼓励AI公司会至少分一些利润给这些创造者,获得一些数据授权。

甲子光年:但大公司多半主要和大公司合作,就像OpenAI会很快和新闻集团达成合作,中小媒体就被遗忘了。艺术可能也是,大公司只和平台合作,独立艺术家无人在意。

单思雄:肯定会出现这种情况。但就像Spotify这样的音乐平台和环球音乐集团(UMG)合作获得版权,环球音乐会把钱分给内部的创作者,可能没有以前那么多钱,但得到一些分成的模式是正确的。现在的艺术家面对AI几乎是一点都拿不到,甚至都算不上被外包的感觉。如果OpenAI和迪士尼达成合作,迪士尼多少会给自己合作的艺术家一些分成。

甲子光年:你有没有想要实现的终极目标?

单思雄:两方面吧。一方面是推动AI企业给创作者一些补偿。如果我是画师,我想每天开心画画,每天发一张图给OpenAI,OpenAI挣钱了也会分红给我;另一方面,即使OpenAI做到了我说的,艺术家现在也不敢把画发给OpenAI,因为它训练几张以后也就学差不多了。可能这不会是一种直接的合作,还会有一些中间步骤,让艺术家去信任它们,这样就比较健康。

甲子光年:你会如何看待你与AI的关系,你之于AI在扮演什么角色?刚刚你说希望它变得更健康,所以你是代入了医生的角色吗?

单思雄:对,我相信AI未来的影响肯定还是很好的,但是目前有一些问题。除了版权,还有Deepfake带来的诈骗问题等等。我觉得我打造的一些工具可以帮助减少这些错误的应用以及它带来的伤害,让AI更好地发展,更好地被使用。

甲子光年:你将来毕业后还会继续研究当前的方向,并拓展到比图像更大的保护范围吗?

单思雄:还是会继续做,但保护也只是一方面,还要关注实施的过程。比如欧洲的《通用数据保护条例》(GDPR)或者美国一些新的法律要想真正实现,也还需要技术上的支持。版权办公室不想给AI生成的作品版权保护,但他们的挑战在于不知道哪些是AI生成的,所以我可以做一个检测工具。

甲子光年:你认为AI生成的图像可以有版权保护吗?

单思雄:即使有,也不应该只属于写prompt的那一个人。

(封面图来源:摄图网,文中图片来自Glaze团队)

发布于:北京

相关推荐

| 甲子光年

2020,一线基金入局机器人 | 甲子光年

一个“洋葱球”引发的天线革命|甲子光年

画的没有AI好,我被裁员了

王慧文“托孤”,光年之外“上岸”

RPA爆火这两年:AI乎?非AI乎?

AI落地机器人,如何在慢赛道里快起来?

数据标注工:训练AI,被AI替代

一小时 12 元,我在北欧监狱里训练 AI

寒冬融资Plan B:风险贷款在中国

网址: 为了防止AI偷图,我在画里“下了毒”|甲子光年 http://www.xishuta.com/newsview120958.html

推荐科技快讯

- 1问界商标转让释放信号:赛力斯 94831

- 2人类唯一的出路:变成人工智能 18279

- 3报告:抖音海外版下载量突破1 17828

- 4移动办公如何高效?谷歌研究了 17547

- 5人类唯一的出路: 变成人工智 17382

- 62023年起,银行存取款迎来 10009

- 7网传比亚迪一员工泄露华为机密 8000

- 8顶风作案?金山WPS被指套娃 6446

- 9大数据杀熟往返套票比单程购买 6423

- 1012306客服回应崩了 12 6370