AI规模定律:为什么Scaling Law如此重要?

一、Scaling Law为何重要

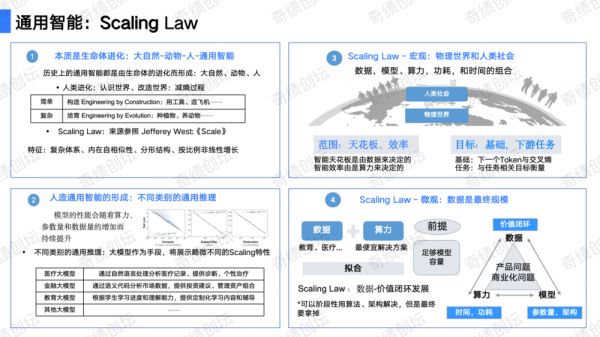

在有关通用智能的讨论中,Scaling Law(规模定律)被频繁提及。为什么 Scaling Law 如此重要?

要解答这个问题,我们可以回溯上篇笔记中提到的对本次变革的理解。通用智能是一个复杂的体系,其带来的变革涵盖科学、技术、生产力和发展模式等各个方面,重塑的将是人类生产力的整个堆栈。

想打造这样的复杂体系,仅凭平均 15 瓦功耗的人脑是难以达成的。人类只能处理简单体系,短期能记忆的概念通常不超过 7 个。因此,在本次技术变革浪潮中,我们必须打破惯性思维,采用完全不同的思考方式。

那么,从哪里找到思考点呢——大自然。

正如 Geoffery West 所著的《Scale》一书所述,大自然中存在各种复杂体系。许多复杂体系在一定条件下表现出符合 Scaling Law 的特性,其本质在于自相似性(self-similarity)。以生命体这一典型的复杂体系为例,不同规模或尺寸的生命体通常具有相似的特征或结构,更大的生命体在某种意义上是更小生命体的按比例放大。从这个角度看,大象可以被视作“放大版的老鼠”。它们都拥有代谢系统,需要呼吸,需要将血液从心脏输送到身体的每个部位。但是,规模越大的生命体所具备的优势,例如能量利用和代谢效率,会呈现非线性增长。

和生命体一样,通用智能体也是高度复杂的体系。由于推理方式、数据连接方式的相似性,更大的模型可以被视作更小模型的结构放大版。其成长同样遵循按比例扩展的规律。同时,随着规模增长,通用智能体性能的提升将是非线性的。规模越大,性能提升越显著。

从 Scaling Law 出发,以大语言模型为例,其性能主要围绕三个维度成长:第一,模型的参数量;第二,训练模型所用的数据量,尤其是数据的熵结构;第三,模型训练所消耗的计算量。随着上述三个要素规模的增加,模型的推理能力将显著提升。感兴趣的读者可以阅读 OpenAI 2020 年发表的一篇关于 Scaling Law 的论文 [1]。

对大模型时代的产品研发人员和创业者而言,找到并利用好模型的 Scaling Law 至关重要。当然,这并不意味着在具体实践中模型越大越好。第一篇笔记中,我们也提到,模型首先需要生存(在资源受限的情况下保持有效性),要争取在同样能进行推理的情况下做到功耗更低、更便宜。

二、如何利用Scaling Law:用数据实现Scale

要利用好 Scaling Law,核心思路是能用数据和算力解决的问题,就一定不用别的方法,尤其是在生产和研发领域。

在模型发展的过程中,算力一直被认为是昂贵的资源。但硬件相关的成本通常是一次性的,边际成本主要来源于功耗。随着相关技术进步和系统架构的优化,功耗逐渐成为影响算力扩展的重要因素之一。而长远来看,随着光伏等能源技术的发展,功耗的终极边际成本可以趋近于零。

当前,中国在全球光伏行业占据主导地位。理论上,利用部分地区的光伏资源有可能大幅度提高能源自给能力,这是历史上的一个重大突破。另外,中国芯片工艺、封装技术等方面能力也在稳步发展。

在这样的历史转折点,创业者应该思考的是如何利用数据来实现 Scale,并尝试回答有哪些数据可以帮助企业解决推理问题,如何获取这些数据,以及接下来能找到什么样的数据来形成数据闭环。

1. 重视间接观察数据

具体而言,何谓数据?对通用智能来说,数据是对环境观察的结果。必须对环境进行观察,否则无法生成数据。任何数据都有四个独立的维度:观察者(视角)是谁,观察对象是什么,观察发生在哪里,以及观察发生在什么时间点。

以互联网文本数据为例,观察者通常是人。观察对象是人的社会交互(特别是工作关系),人所处的物理环境,以及一些可以间接观察到的人的思考路径。观察的空间主要是办公地点,观察时间则通常集中在工作时间内。

从模型学习的角度来讲,what's not observable is not learnable(看不到的东西模型是学不到的)。基于此,我们就需要拷问,今天互联网上有什么信息?这些信息有什么规律?透过这些规律,模型能学到什么?

目前,互联网上能获取的数据以公开信息和知识为主,模态主要为文字,也包含一些图像。同时,互联网的功能是传播信息而非完成任务。如果仅凭今天的互联网公开数据,OpenAI 能做的非常有限。相较之下,存在于视频社交媒体平台中的数据比今天的互联网数据更强大。其观察对象覆盖了人们的衣食住行等工作、生活的各个方面,观察时间几乎是 24 小时。这些平台可能会在未来发展中占据有利生态位。

同样,以特斯拉的自动驾驶系统(FSD)为例。它的数据观察者是车顶上的摄像头,是鸟瞰视角。观察对象是车辆及其周围的道路环境,观察空间是路面空间,观察时间大多是通勤时间,数据模态是声波、图像。虽然 FSD 目前表现相对较好,但仅靠这些数据,并不能完全替代人类的驾驶行为。因为影响驾驶行为的不仅仅是视觉的体验,还有情感和其他环境因素。例如,后座上的小孩在哭闹,或者车内有重要领导人,驾驶方式都会有所不同。甚至窗外的美丽风景和车内的音乐都可能影响驾驶行为。这些人类体验数据是目前的摄像头和传感器难以捕捉的。

通过上述例子,我们试图再次说明:有什么样的数据就会带来什么样的通用智能。上篇笔记已经提到,创业者需要收集两类数据:任务路径数据(直接观察数据)和思考路径数据(间接观察数据)。人类的逻辑、思考体系和思考框架大多存在于间接观察数据中。这些数据对提升模型的推理能力至关重要。因此,创业者应特别关注此类数据的收集和利用。

2. 向模型投入高质量同领域数据

此外,利用数据实现 Scale 的另一个关键点是,在训练模型时投入足够的高质量同领域数据。

通用智能的核心是推理(reasoning)。而推理能力最终来源于模型的记忆,是从记忆中泛化而来的。这就要求模型学习的数据中应当包含推理所需的规律性(regularity),并关注数据的多样性(diversity),即推理路径对相应领域的覆盖范围要足够广。

这里的“记忆”指:推理能力的基础来源于模型在训练时从数据中学习到的知识和规律性(regularity)。这些知识和规律性被编码到模型的参数中,形成了模型的“记忆”。

以自然界的现象为类比,大象的大脑参数量其实比人类的大很多,但它的聪明程度和推理能力远不如人类。其中一部分重要原因是人类获取的数据比大象丰富、复杂得多。大象由于体型高大,主要感知到的环境是树叶、树梢和天空,再加上力量强大,其他动物不敢与之接触,所以生活经验相对单一,数据输入的多样性和复杂性较低。相比之下,人类由于生活于复杂的环境中,积累了丰富的生存经验,吸收了更优质的数据,从而发展出更高的智能和更强的推理能力。

3. 关注特定于环境/领域的通用模型

另外需要作出说明的是,不同数据可能适用不同的推理任务,同时 Scaling 有一定的相对性,不同模型 Scaling 的要素也会有所不同。正如动物,鱼类、飞禽都有各自的 Scaling。人类的 Scaling 也与其他哺乳动物略有不同,因为人类的前肢可以用来操作工具。

基于此,我们应当关注不同领域的通用模型。例如,在医疗领域,可以有一个模型能够支持通过对话快速找到相关的医疗记录,如 X 光片,并进行初步诊断。针对金融和教育两类场景,同样可以有这样的模型。但需要强调,模型仍然是通用推理,而非专用推理。当前,针对特定问题或任务的专用推理难以真正投入使用,因为它总是面临无尽的长尾问题和不断出现的新情况。但是,这样的领域特定通用模型本身无需极其庞大的参数规模。

从更宏观的层面来看,不同国家也有不同的数据。为了能够更好地服务中国社会的方方面面,中国的通用模型需要依赖中国的数据。这包括但不限于中国的地理环境、基础设施、中国文明、社会交互方式、中国医院的运作模式、中国城市的运营方式以及中国铁路的运行方式等。

例如,假设一个大模型创业者希望在中国的电商行业中取得领先地位,那么他就需要了解中国商品的销售方式、中国用户的需求表达方式以及中国的物流体系。将所有与中国电商相关的数据整合起来,才能建立一个能够处理所有相关问题的通用模型。

从这个角度,在不同国家之间做模型的横向对比是没有意义的,因为每个国家的数据集和要解决的问题可能截然不同。正如不同环境会长出不同的果树,产出不同的果实,不同的物理环境和社会环境也将催生出不同的通用智能。

三、结语:在大模型时代保持开放的心态

对创业者而言,在当前的变革面前,需要保持好奇心和开放心态。

有一位研究人类科学发展的学者曾说过,科学只有在老一代或年轻一代思想“消失”时才会进步。只有不断克服思想上的惯性,多问“为什么”,不断挑战自己过去的想法,不依赖人类今天的经验去解决问题,才能真正拥抱变革。

迄今为止,业界关于 Scaling Law 的探讨尚未形成统一的意见。但需要说明,所有的理论都有局限性,包括数学、统计学等传统科学。重要的是它们是否有用(All theories are wrong but some are more useful than others),是否能满足人们的需求。

简单举例,过去,人类的科学探索基本依靠数学,因为它是一个自洽体系。然而数学并不完备,最关键的缺点在于其没有时间和过程概念。从这个角度看,计算(Computation)优于数学。第四范式科学强调使用计算来进行推理,而不仅仅依赖数学。这并非要取代数学,而是承认在许多实际应用中,计算能够处理复杂问题,提供更强大的分析能力。

最后,再次回到如何理解通用智能,指导实践的问题。通用智能是环境的映射,是数据的产物。在大模型时代,创业者需要找到并利用 Scaling Law,尝试从数据和计算着手来解决问题而非依赖人类今天的经验。

推荐文献:

[1] Kaplan, J., McCandlish, S., Henighan, T., Brown, T. B., Chess, B., Child, R., Gray, S., Radford, A., Wu, J., & Amodei, D. (2020). Scaling laws for neural language models. arXiv preprint arXiv:2001.08361.

本文来自微信公众号:奇绩创坛,作者:奇绩创坛

相关推荐

图灵奖得主专访:我不想把大模型未来押注在Scaling Law上

AI规模法则:大力何以出奇迹?

对话爱芯元智创始人仇肖莘:大模型Scaling Law不会持续增长,一定会出现放缓期|直击WAIC 2024

OpenAI与DeepMind的Scaling Laws之争

硅谷秘籍:这三个定律推动科技发展

互联网人来答:梅特卡夫定律不如猫鼬定律?

为什么OpenAI可以跑通所有AGI技术栈?

Sora带来的四点启发

AI爆发,是新时代的电力革命

为什么说Sora是世界的模拟器?

网址: AI规模定律:为什么Scaling Law如此重要? http://www.xishuta.com/newsview124515.html

推荐科技快讯

- 1问界商标转让释放信号:赛力斯 95124

- 2人类唯一的出路:变成人工智能 20535

- 3报告:抖音海外版下载量突破1 20375

- 4移动办公如何高效?谷歌研究了 19720

- 5人类唯一的出路: 变成人工智 19648

- 62023年起,银行存取款迎来 10272

- 7网传比亚迪一员工泄露华为机密 8400

- 8五一来了,大数据杀熟又想来, 8039

- 9滴滴出行被投诉价格操纵,网约 7662

- 10顶风作案?金山WPS被指套娃 7184