尤瓦尔·赫拉利:AI真正的威胁,是官僚而不是终结

历史,从来都是由讲故事的人书写的。从史前时代的岩画,到当今社交媒体上的每一条信息,人类不断通过讲述、传播和接收故事来构建自己的认知世界。每一个文明的兴衰,每一次思想的革新,甚至是我们每个人对世界的理解,都是在无数个故事的编织中逐渐成形。正如《人类简史》的作者尤瓦尔·赫拉利(Yuval Noah Harari)在接受《Noema》主编内森·加德尔斯(Nathan Gardels)的访谈时指出的:人类是一群“很会讲故事的动物”。

然而,在这个信息爆炸的时代,故事的讲述出现了前所未有的变革。人工智能(AI)的出现,不仅改变了故事的生产方式,更在根本上挑战着人类对认知、真相与现实的理解。当AI能够自主生成内容、塑造叙事,我们的个人认知和社会走向将何去何从?

在这场深度对谈中,赫拉利不仅探讨了这个时代真正面临的AI威胁(并非AI反叛),更深入思考了在技术快速发展的今天,人类该如何在信息洪流中保持清醒,在AI重塑叙事的时代维护人类的主体性。

尤瓦尔·赫拉利 Yuval Noah Harari:

历史学教授,牛津大学博士,耶路撒冷希伯来大学教授

以色列历史学家、哲学家和作家,以其对人类历史与未来的深刻洞察而闻名。他的研究领域涵盖宏观历史学、自由意志、意识以及人工智能等主题。他的代表作《人类简史》、《未来简史》和《今日简史》已被翻译成65种语言,全球销量超过4500万册,广受欢迎。他的作品和演讲探讨了人类文明的过去、现在与未来的关键问题,被广泛引用并在世界范围内引发讨论。他曾接受BBC、TED等平台的采访和演讲,其思想影响力遍及全球。

一、人类是一群很会讲故事的动物

内森·加德尔斯:你的作品中提出了一个观点,人类的独特之处在于能够创造能够使人信服的故事,这些故事不仅能凝聚人心,更能推动群体协作。正如法国哲学家雷吉斯·德布雷(Régis Debray)在思考戴高乐如何在二战后重振国家时所写的:“是神话造就了人民,而不是人民造就了神话。”你在新书《涌现》中提到,“历史进程中最重要的是传递这些叙事的信息网络”。你能结合一些历史案例进一步阐述这一观点吗?

尤瓦尔·赫拉利:大规模群体协作,是我们人类的超能力。为了实现这一点,就需要众多个体在法律、规范、价值观和行动计划上达成一致。那么,如何将芸芸众生串联成一张网络呢?答案是需要通过信息,尤其是通过神话、叙事和故事来连接彼此。我们人类本质上是一群很会讲故事的动物。

可以类比有机体或身体的运作机制。生命最初只有单细胞形态。经过数亿年甚至数十亿年的漫长演化,才出现了像人类、大象或鲸鱼这样的多细胞生物。对于多细胞生物来说,最大的难题在于:如何协调这些数以十亿计的细胞,使其成为一个运转有序的整体,让肝脏、心脏、肌肉和大脑能够朝着共同目标协作?

在生物体内,这种协作是通过信息传递实现的。无论是通过神经系统,还是激素和生化成分,这绝非单一的信息网络,而是多个信息网络的协同运作,才使得身体能够维系下去。

国家、教会、军队、公司也一样。关键问题是,如何让这些成千上万的人类“细胞”,如同一个生命体般的配合无间?对于人类而言,最有效的方式就是讲故事。

以宗教为例,历史上,视觉符号、图像和图标始终是最普遍的表现形式。其中,耶稣的形象最为广为人知。

2000多年来,亿万张耶稣的画像被创作出来,遍布世界各地的教堂、大教堂、私人住宅和办公场所。这些画像最神奇的地方在于,没有一张是“真实”的。

之所以说没有一张“真实”,是因为无人知晓耶稣的真实样貌。我们没有他生前的任何画像记载。在当时的罗马帝国,他不过是一个偏远行省中微不足道的人物,可能仅有数千人亲见过他或听闻过他。真实的耶稣在当时的历史影响微乎其微。

然而,后世创造的耶稣形象和故事却对历史产生了深远影响。即便在圣经中,也只字未提耶稣的相貌。除了一处提及他的衣着,但没有任何关于这个人是高是矮、胖是瘦、金发还是黑发的描述,什么都没有。

几个世纪以来,这个被创造出来的形象被亿万信徒铭刻心中,他的故事已经将数十亿人团结起来,近2000年间,从慈善、医院和扶贫,到十字军东征、宗教裁判所和圣战,催生了各种各样的影响。归根结底,这一切都源于一个故事。而教堂网络,实际上就是这一切的“神经中枢”。

问题是,教堂在向人们传达什么信息,是号召人们奉献财物、投身慈善,还是煽动信徒讨伐异教徒与异端?

二、真相是一种极其珍稀且代价高昂的信息形式

内森·加德尔斯:你提到基于故事建立起的网络通过传递信息来凝聚人心。但你也警示过“信息天真论”可能会适得其反,甚至带来负面影响。能请你详细解释一下这个观点吗?

尤瓦尔·赫拉利:在像硅谷这样的地方盛行一种对信息的天真理解,认为“信息等同于真相”。如果信息就是真相,那么信息量的增加必然带来知识与智慧的提升,仿佛任何问题只要获取更多信息就能解答。

即便信息中确确实实存在着谎言、宣传信息和虚假内容,“信息天真论”的支持者仍认为:“解决的方法,在于更充分的信息获取与信息自由。只要让信息汪洋充盈世界,真相、知识与智慧自然会像泡沫般浮现出来。”

然而,这种观点是完全错误的。事实上,真相是一种极其珍稀且代价高昂的信息形式。

放眼整个世界,大部分的信息都并非真相。绝大多数信息都是垃圾,由虚构、幻想、错觉、幻象和谎言构成。获取真相需要付出巨大代价,而编造虚假信息却轻而易举。

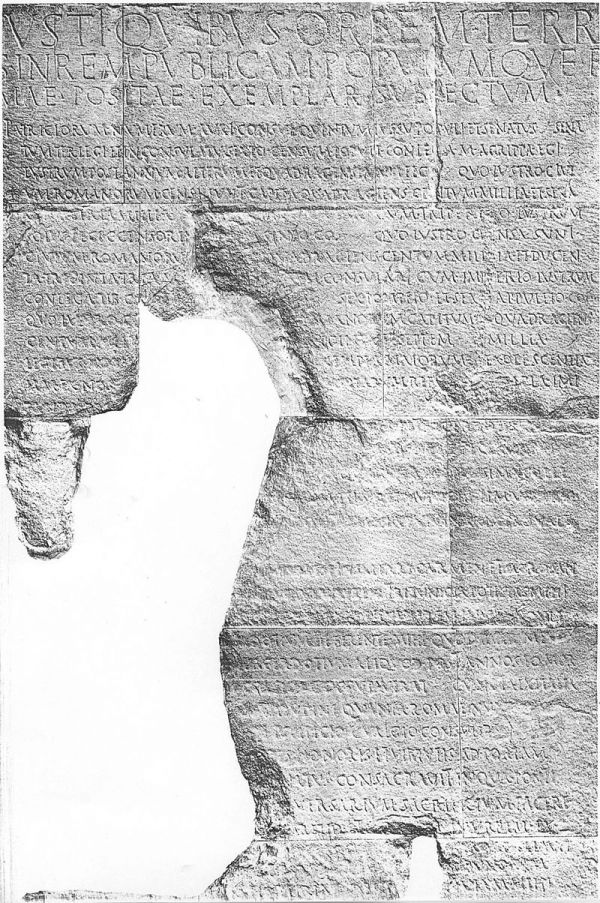

如果你想写一篇关于罗马帝国往事的真实记述,你需要投入大量的时间、精力和努力。专业研究者需要在学院中花费十余年时间,学习拉丁语和希腊语,掌握古代碑文阅读技能。即便如此,当你发现了一份奥古斯都·凯撒的碑文记录,也无法判断它是否真实——它可能是政治宣传,也可能是错误记载。辨别真伪,本身就代价高昂。

▷图2.奥古斯都神功业记部分铭文。来源:维基百科

相比之下,如果你想创作一个关于罗马帝国的虚构故事,那就容易得多。你只需随心所欲地书写脑海中的想象,无需考证史实,无需掌握古典语言,也不必进行考古发掘,或解读陶器碎片的历史意义。

更重要的是,真相往往错综复杂,而虚构却可以任意简化。比如关于罗马共和国衰落或帝国覆灭,许多人倾向于将其简单归因于道德败坏。然而,历史的真相总是由众多因素交织而成,而虚构的故事可以随意简化。

内森·加德尔斯:虚构更易被理解,也让此类叙事能够吸引如此多的注意力。

尤瓦尔·赫拉利:没错。真相往往令人痛苦。即便是在个人层面,要想坦然面对自己的行为、审视我们如何对待亲人和自我,都需要莫大的勇气。这也是为什么许多人需要通过多年心理治疗才能直面这些真相。

这同样适用于国家和文化层面。以我的祖国以色列为例,如果某位政治家要完整、毫无保留地阐述以巴冲突的真相,他必定无法在选举中胜出——这是不争的事实。人们本能地抗拒这样的真相。这种情况在美国、印度、意大利乃至世界各国都普遍存在,宗教领域也不例外。

真相总是缺乏吸引力,而虚构却能将现实包装成令人愉悦的形态。在这场竞争中,昂贵、复杂且不讨喜的真相,必然会输给廉价、简单且令人愉悦的虚构。

仅仅依靠信息的泛滥无法让真相胜出。若要让真相、知识与智慧占据上风,我们必须重塑这个竞争环境。建立专门机构,投入充足的时间、资源与努力,去探寻真相、阐释真相并传播真相。这些机构可以包括研究机构、高等学府、新闻媒体和司法机构等——尽管即便在司法系统中,真相的探寻也绝非易事。唯有投入资源去培育这些机构,我们才能保有追寻真相、积累知识、培养智慧的希望,从而扭转当前的失衡状态。

三、叙事战争

内森·加德尔斯:换言之,虚构与错觉在维系社会凝聚力上扮演着关键角色,这使得信息网络倾向于维护秩序而非揭示真相,因为真相往往具有破坏性。

尤瓦尔·赫拉利:是的。信息网络的正常运作,需要两个要素:一是掌握必要的真相,因为完全脱离现实必然导致崩溃;二是维持秩序与凝聚力。

这就像人体的运作。既需要了解一些关于世界的真相——如何获取水分、食物及躲避天敌,也需要确保数十亿细胞的协同运作。这一原理同样适用于军队、教会和国家等组织。

对于社会而言,维系凝聚力和集体合作的秩序往往比真相更为重要。

以核武器研发为例。物理学真理固然不可或缺——忽视物理定律,原子弹就无法引爆。但仅有真理远远不够。即便最杰出的物理学家精通相对论与量子力学,也无法独自完成这项工程。还需要矿工开采铀矿,需要专业人员设计建造反应堆和离心机,还需要农民为所有参与者提供食物保障。

要调动如此庞大的人力,你需要一个故事、一个神话、一种意识形态。而在这种大规模动员的叙事中,事实反而退居其次。

现实中,掌握核物理知识的人往往要听命于意识形态的掌控者,在伊朗是什叶派神学家,在以色列是犹太教学者……主导秩序的人指挥着掌握真相的人,这是历史的常态。

内森·加德尔斯:连接网络呈现出明显的双重特性,它既可以促进社会凝聚力和集体行动,也可以制造分裂。在当今点对点社交媒体的生态中,这种双重性尤为突出。各个群体都在构建专属的身份认同,坚持自己的“真相”,编织独特的叙事体系。这种现象催生了一个个亚文化“群岛”,造就了碎片化的现实认知,最终反而侵蚀了社会凝聚力。

正如韩裔德国哲学家韩炳哲(Byung-Chul Han)所说,“点对点连接模式,是私人空间之间的流动,而非公共领域的营造。”没有公共领域,就无法形成社会凝聚力。因此,出现一个悖论:凝聚力的双重效应(无论善恶)与深度碎片化同时存在,最终导致秩序的瓦解。

尤瓦尔·赫拉利:完全正确。故事能够团结人心,也能制造分裂。正因为一个具有约束力的主导叙事对维系社会秩序、保持群体团结具有不可替代的作用,“叙事战争”才成为了最具破坏力的战争形式——它能够从根本上瓦解整个社会网络的内在联系。从这个角度来看,它确实具有双面性

四、赋权与控制

内森·加德尔斯:信息网络还有另一方面的双重特性:它们既可以集中权力,也可以分散权力。

DeepMind联合创始人穆斯塔法·苏莱曼(Mustafa Suleyman)对这种矛盾本质有着精准的描述:“互联网在少数几个枢纽上集中,同时又赋予数十亿人力量;它创造了巨头,同时又让每个人都能参与其中。社交媒体创造了几个巨头和数百万个部落。每个人都可以建立一个网站,但只有一个谷歌;每个人都可以销售他们的小众产品,但只有一个亚马逊。互联网的颠覆性,很大程度上源于赋权与控制之间那种强烈而又易燃的张力。”

换句话说,网络连接虽然倾向于更高效的集中,但也创造了数十亿种可能性。那么,人工智能的出现,又将如何放大这些信息网络模型的影响?

尤瓦尔·赫拉利:我们还不完全知晓。存在一种广为人知的假设,AI可能会决定性地倾斜“民主-集权”的天平,支持集中式信息网络。

让我们从历史的角度来分析这个问题。20世纪末,美苏冷战以民主获胜而结束。从信息的角度而非伦理角度来看,苏联试图将所有信息集中到一处,效率极其低下。处于中心的个人无法有效处理如此海量的信息,导致决策失误,特别是在经济领域。而缺乏纠错机制的情况下,错误决策积累最终导致了苏联的崩溃。

而美国则采取一种分布式信息系统,允许信息在多个节点间自由流动,经济决策不仅仅依赖少数官员。更重要的是存在纠错机制——决策者犯错时可以被替换,错误可以被纠正。这种分布式系统在经济的效率竞争中最终胜出。

现在,AI的出现可能改变这一切。当将所有信息集中到一个地方时,人类无法处理海量数据,而容易做出糟糕的决策。但AI则不同,它以信息为食,数据越多越好。20世纪因人类局限性而失败的集中式系统,在21世纪可能因为AI的加入而变得可行。

如今一种趋势已经显现——即便在资本主义社会中,越来越多的领域被单一巨头垄断,而AI算法正在催生高度集中的信息网络。

然而,并非所有人都同意这种分析。

这个趋势的一个明显不足是自我纠错机制缺乏的问题仍未改变。即便AI能够处理集中的信息,它仍然会犯错,而且可能是灾难性的错误。如果没有纠错机制,这种失误将无法得到及时修正。

另一个需要指出的问题是,AI对人类独裁构成的威胁。纵观历史,独裁者最大的威胁从来不是民主革命,而是来自更强大的下属。没有一位罗马皇帝死于民主革命,却有很多死于将军、总督或亲信之手。对独裁者而言,引入AI就像在宫殿中安置一个无法控制的超级下属。

回顾历史,当权力集中于一人时,谁能控制这个人,谁就能控制整个帝国。而独裁者往往性格偏执,容易被操控。历史上的古代王庭中,总有君主被宦官、佞臣操控。对AI来说,学会操控一个偏执的统治者,就像从孩子手里偷糖一样简单。因此,对独裁者而言,AI既是诱人的工具,也是潜在的威胁。如果要我给这些统治者建议,我会说:“对AI保持警惕,不要贸然拥抱它。”

五、外星智能

内森·加德尔斯:AI最令人忧虑的不是其技术本身,而是它正在掌控人类文明的“关键钥匙”——语言能力和构建凝聚社会的叙事力量。这种能力的转移可能从根本上威胁人类的存在。从这个角度看,AI就像一股“外星”的力量,对我们的物种构成前所未有的挑战。

尤瓦尔·赫拉利:我认为,AI的全称或许不该是“人工智能”(Artificial Intelligence),而是“外星智能”(Alien Intelligence)。这里的“外星”,不是指来自外太空,而是指它以一种完全异于人类的方式思考、决策和处理信息,甚至是以非有机体的智能形式存在。

与人类历史上所有其他发明不同,AI不是一个被动的工具。印刷机不会自主决定印什么,原子弹不会自行选择目标。但AI具有自主决策能力,它能决定打印什么、攻击什么,甚至能主导新一代AI的开发。这使它成为一种前所未有的存在。

这是第一次,我们不得不在地球上与一个非常聪明的智能体打交道。而且,我们面对的不是一个智能体、一个超级计算机,而数以亿计的AI智能体网络。它们正在渗透到社会的各个层面:银行的贷款审批、企业的招聘决策、教育机构的录取评估,甚至军事打击目标的选择——这些都将逐渐由AI主导。

这些现在所看到的,还只是开端。现今的AI,如ChatGPT,依然非常原始,正处在“变形虫阶段”。但与生物进化不同,AI的进化速度快得惊人。生物从单细胞进化到复杂生命形式需要数十亿年,而AI可能在短短二十年内就完成类似的跨越。2040年或2050年,我们很可能就会遇到“AI霸王龙”级别的智能体。

理论上来说,AI并不是我们可以规划并预测其所有行为的东西。如果你能预见它的所有行为,那它就不是AI。

正因为AI具有自主学习和进化的能力,简单地制定规则或设置安全机制是远远不够的。这种思维方式低估了我们面对的挑战:AI不是一个可控的工具,而是一个能够自主行动、不断进化的外星智能。

内森·加德尔斯:即使在AI的“变形虫阶段”,我们就已经看到它的影响力了,不是吗?

尤瓦尔·赫拉利:确实如此。AI带来的挑战并非未来的假设,而是已经显现的现实。Twitter/X、YouTube或Facebook使用的社交媒体算法,这些“原始AI”的实践已经给我们敲响了警钟。虽然它们在技术层面还很初级,却已经对全球民主和社会稳定造成了深远影响。

表面上看,这些算法的目标似乎无害——提升用户参与度,增加平台停留时间。然而,AI找到了一条出人意料的路径:它发现激发人类的负面情绪(仇恨、恐惧、贪婪)是提高参与度的最有效方式。当大脑中的“仇恨按钮”被触发时,用户会不自觉地被内容吸引,从而延长平台停留时间,算法就会趁机投放大量广告。

这种结果并非平台创建者的初衷。马克·扎克伯格等人并没有指示算法故意传播负面情绪,他们只是将权力交给了这些算法,而算法按照自己的逻辑做了意料之外的选择。因为它们是AI,而这就是AI的本质。

更令人担忧的是,目前造成社会撕裂、威胁民主根基的仅仅是最初级的“变形虫AI”。试想一下,未来10~20年后更复杂的“恐龙级别”AI模型,将会造成何其惊人的影响?

六、AI真正的威胁,不是“终结者”

内森·加德尔斯:好莱坞在《终结者》和《银翼杀手》等电影中,将AI塑造成“反抗主人的叛变机器人”的形象。这是正确的吗?

尤瓦尔·赫拉利:不,这完全是误导。好莱坞电影确实很早就开始探讨AI威胁,但其描绘的场景反而产生了误导效应。在这些作品中,具备通用智能的机器人能够自主建造工厂、组装军队,最终发动叛变。这种描绘方式让人们对AI的真实威胁产生了错误的预期:当他们环顾四周,没有看到“终结者”式的场景,就以为AI威胁尚未来临。

实际上,如今的AI并非如此。AI更像是“专业型白痴”——在极其狭窄的领域里表现出色,但无法跨界执行其他任务。例如,AlphaGo会下围棋,但不会烤饼干;军事AI擅长目标识别,但不能制造武器。但是,就像一位精通税法但不会烤面包的顶尖律师,被扔在大草原上时他是无助的,无法与大象或狮子抗衡;但当他们处于现代法律和官僚体系中时,其影响力能比世界上所有的狮子加起来都更强大——因为他们懂得如何按下信息网络的杠杆,利用官僚机构和系统的巨大力量。

这正是科幻电影所遗漏的是,AI不需要从零构建自己的帝国,它们正被植入现有的社会系统,完全可以从内部接管这些系统。AI正在积蓄的威胁,不在于它能否独立建立军队,而在于当它被植入现有的银行、媒体等关键系统时所能施展的影响力。这才是我们真正需要警惕的方面。

内森·加德尔斯:所以,放任算法精神体(Algorithmic Spirits)进入信息网络的官僚机构,才是我们应该关注的核心问题?那么,是不是AI在大型系统的琐碎任务中的存在,同样让人担忧?

尤瓦尔·赫拉利:是的,我们需要担忧的不是“终结者”,而是“AI官僚”。就像在战争中,按下触发器的可能是人类,而命令却来自“AI官僚”。

内森·加德尔斯:一些科技巨头宣称,鉴于他们在社会中的关键地位,他们有能力也有责任管控AI风险——如果强大的AI模型变得过于强大并威胁到人类的自主决策,他们可以拔掉电源或按下“终止开关”。对此,你有信心吗?

尤瓦尔·赫拉利:这所能实现的范围非常小。这就像工业革命时期,所有的煤炭和石油巨头向公众承诺:“一旦发现工业活动造成污染、威胁生态,我们会叫停。”你怎么可能叫停工业革命?又怎么可能拔掉互联网的插头?

这些科技巨头他们想到的仅限于应对单一企业、特定场所或个别模型的故障。诚然,在发现未经授权的系统试图启动核武器这类极端情况时,我们确实可以采取紧急干预。但这并非最大的威胁。

真正的挑战在于,未来将会有数以十亿计的“AI官僚”渗透到全球各个领域——从医疗到教育,从金融到军事。如果到那时我们发现某个环节出现严重问题、情况失控,该如何应对?我们不可能指望能够同时关停全球所有的军事、医疗和教育系统。这种完全不现实的应对方案,本身就是一种误导。

内森·加德尔斯:如何防范算法精神在各个人类系统中的扩散呢?

尤瓦尔·赫拉利:首先要理解并正确概念化问题。不应将AI风险简单地想象为科幻电影中的机器人叛乱,而是像我们刚刚讨论的那样,认识到真正的威胁是从内部接管系统的AI。我们人类总是急于寻找对策,结果却误判了问题本身。我们需要停下来,先深入理解问题到底是什么,而非急于提出解决方案。

七、彩蛋:尤瓦尔·赫拉利如何获取信息?

内森·加德尔斯:从《人类简史》到《未来简史》,再到《涌现》,你的书中包含的知识内容堪称百科全书级别。您的著作展现出令人惊叹的知识广度和深度,堪比一部现代百科全书。您的思维方式让人联想到当下的大型语言模型——问一个问题,按下按钮,所有内容就会涌现出来。你如何获取信息?平时都会阅读什么?

尤瓦尔·赫拉利:首先,我有一个由四人组成的研究团队。当我需要深入了解某个领域,比如尼安德特人或AI相关的知识时,我会向专门研究这些课题的团队成员请教。

我本人有个习惯“信息节食”,这和“食物节食”类似。在这个信息泛滥的时代,我建议每个人都该学会“信息节食”。就像我们会谨慎选择食物一样,我们也应该认真考虑自己每天接收什么样的信息,接收多少信息。

我更喜欢读长篇著作,而不是刷短平快的社交媒体。比如说,当我想真正理解乌克兰或黎巴嫩的局势时,我会找几本相关的好书仔细阅读。具体选择什么书,要看我研究的问题——可能是关于大型语言模型(LLMs)的,也可能是关于罗马帝国、历史、生物学或计算机科学的。

还有一点很重要,我会进行“信息禁食”。由于大多数信息是“垃圾”,仅仅将更多信息填充进脑袋并不会让你更聪明或更有智慧,只会让人满脑废物。

所以,摄入信息固然重要,但我们更需要时间来消化和沉淀。为此,我每天冥想两个小时。每年,我都会进行一次长时间的静修,持续30到60天,在此期间,我不会摄取任何新的信息。静修是完全静默的——在冥想中心里,甚至不与人交谈,只是专注于处理、消化和净化这一年中积累的一切信息。

我知道,对大多数人来说这可能过于极端,毕竟不是每个人都有这样的时间和条件。不过,我依然觉得每个人都该更用心地规划自己的“信息节食”,哪怕是从小规模的“信息禁食”开始——可以是每周抽出一天,或者一周时间,又或者每天固定几个小时,在这段时间里不接触任何新信息。

八、后记

人类以故事理解世界,又以故事重塑现实。在这场深度对谈中,赫拉利以“讲故事的动物”为切入点,揭示了一个令人深思的现实:在信息与技术高度发达的今天,故事的力量不减反增,但真相却愈发珍稀。从个人认知到集体意识,从社会共识到历史进程,都在被各种形式的叙事不断重塑。而人工智能的加入,更让这场“叙事革命”充满了未知与挑战。在这个故事泛滥的时代,也许我们每个人都需要像赫拉利提倡的那样,学会“信息节食”,在纷繁复杂的叙事洪流中守护独立思考的能力,这不仅关乎个体的思想自主,更关乎人类文明的未来走向。

为提升阅读体验,本文对听稿进行了适当的编辑。原采访指路:https://www.noemamag.com/al-will-take-over-human-systems-from-within/

本文来自微信公众号:追问nextquestion (ID:gh_2414d982daee),嘉宾:尤瓦尔·赫拉利、内森·加德尔斯,编译:1900,审校:一木

相关推荐

尤瓦尔·赫拉利:无需发展出意识,AI就能威胁人类文明

《人类简史》作者尤瓦尔·赫拉利:我对未来世界的五个判断

李飞飞 PK 赫拉利:机器人要来抢对象了?

尤瓦尔·赫拉利:人类是如何走上自我毁灭的道路的?

独家对话《人类简史》作者尤瓦尔:我们需要防止人工智能失控

2019 年最精彩 AI 论战:李飞飞论战《未来简史》作者赫拉利

对话《人类简史》作者赫拉利:我们谈到了44、2%、Bad Guy、2020、WTF

AI时代的三大问题

李飞飞对话《人类简史》作者赫拉利:AI 会增强人类,还是操纵人类?

少数派的未来猜想 | 和《未来简史》作者聊完AI,我觉得自己会爱上一台冰箱

网址: 尤瓦尔·赫拉利:AI真正的威胁,是官僚而不是终结 http://www.xishuta.com/newsview130845.html

推荐科技快讯

- 1问界商标转让释放信号:赛力斯 94941

- 2人类唯一的出路:变成人工智能 19160

- 3报告:抖音海外版下载量突破1 18878

- 4移动办公如何高效?谷歌研究了 18405

- 5人类唯一的出路: 变成人工智 18262

- 62023年起,银行存取款迎来 10117

- 7网传比亚迪一员工泄露华为机密 8165

- 8顶风作案?金山WPS被指套娃 7090

- 9大数据杀熟往返套票比单程购买 7039

- 10五一来了,大数据杀熟又想来, 6783