图灵逝世66年后,AI可以自我思考了吗?

编者按:本文来自微信公众号“腾讯研究院”(ID:cyberlawrc),作者:王焕超,36氪经授权发布。

图灵的毒苹果

1954年6月7日,艾伦·麦席森·图灵被发现死在家中。剥夺图灵生命的是一只沾有氰化物的苹果,尽管他母亲坚持这是一桩意外——因为图灵的住所常常散落着各种危险化学试剂,但大多数人都认为,这是图灵难以忍受侮辱而做出的选择。

两年前,图灵因同性恋取向而被英国政府定罪,随后在接近长达一年的时间里一直进行着所谓的“荷尔蒙疗法”,即接受雌激素注射,伴之而生的乳房发育等副作用让他饱受折磨、痛苦不堪。*

图灵的早逝无疑是人类历史上的一个巨大损失。作为“计算机之父”、“人工智能之父”,图灵在计算机科学与人工智能领域有诸多贡献,他提出的“图灵机”设想启发了现代计算机的发明,而其更著名的“遗产”,是一种用于判定机器是否具备智能的测试方法,即“图灵测试”。

图片来源于网络

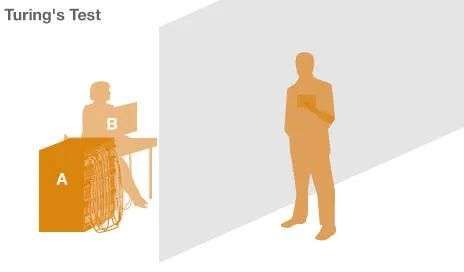

在1950年发表的《机器能思考吗?》一文中,图灵第一次提出“机器思维”的概念,他大胆假定机器将产生思考能力,并给出了测试方法:假如一台机器通过电传打字机与人沟通,如果有超过30%的人无法在特定时间(5分钟)内分辨出与自己交谈的是人还是机器,即可认为该机器具有思考能力。图灵还预言,到2000年时,将出现足够聪明的机器能够通过测试。

这一测试的聪明之处在于,“意识”、“思维”、“智能”都是难以通过定义来阐释的东西,那索性就不去思辨概念,而是用另一种公认具有思考能力的生物——人类来作为参照物。如果一台机器的表现与人类难以区分,即可被视为具备了人类智能。

直至今天,“图灵测试”也是衡量AI智能程度的重要标尺,研究者们乐此不疲地尝尽方法以试图通过测试。可以说,这七十年前提出的思想实验对当今人工智能领域依然有十分深远的影响。

但并非所有人都将“图灵测试”奉为圭臬。部分研究者指出,这一测试手段可能已经过时,它体现出极强的人类中心主义,其本身的设计也具有极大缺陷。它所导向的是一种欺骗性思路,即AI只要成功“欺骗”了人类,就可被视为是拥有“智能”的主体,这在某种程度上误导了AI研究的发展方向,对“智能”的评判也并不科学。

1980年,美国伯克利大学哲学教授约翰·塞尔设计了另外一种思想实验——中文屋实验,用以证明通过“图灵测试”的机器并非真正智能。一个只懂英语、完全不懂中文的人被锁进一个房间,房间内还有一箱中文字片以及指导如何使用字片的手册。

而房间外是一个毫不知情的人,他向屋内递进字条用中文进行提问,房间里的人按手册指导来挑选字片,并且递出正确答案的字片。单从结果来看,这个人无疑能成功通过测试,但实际上他对中文一无所知。

塞尔认为,房间里的人就跟通过图灵测试的机器系统一样,无须理解输入输出字符的含义,只要按照规则搬弄字符,就能形成一种具备真正理解能力的假象。实际上,二者都算不上是真正的理解,最多只是一种扮演行为,并不具备任何思考能力。

中文屋实验与图灵测试在哲学界和认知科学领域引发了广泛讨论,两种实验各有大量拥趸与反对者。当然,“图灵测试”侧重确立一种衡量AI智能与否的基准,中文屋实验反对的也只是前者的思路,却并未否定其前提,即人工智能将拥有真正的智能。

但距离图灵预言具备人类智能水平AI将出现的2000年,已经过去了二十多年,虽然人工智能产业发展得如火如荼,但真正人工智能似乎还遥遥无期。一个问题被摆上台面并促逼我们思考:

人工智能,到底会有自我意识吗?

AI意识问题,比想象中更重要

与学者们面红耳赤的激烈争吵不同,大部分吃瓜群众会觉得,人工智能产生意识只是一个时间问题,因而并不重要。这可能是影视作品带来的一种错觉——毕竟在大部分未来主题的电影中,AI都是具有意识和情感的。实际上,很多人都低估了这个问题的重要性,但它甚至决定着人类未来命运的走向。

图片来源于网络

与处理能力有限的人脑相比,AI的处理能力在理论上是无限的,可以无差别处理收集到的全部信息。一旦AI获得意识,它们能够像人类一样交换、分享信息,只不过在效率上是碾压人类的。作为结果,AI的智能水平将迅速崛起,并会“消灭”掉包含人类在内的低智能主体——这并不是大屠杀,而是与智能手机淘汰功能机一样的“市场行为”。

现实可能没有那么可怕,拉回一点时间线,在AI“毁灭”人类社会之前,假设它的意识水平仍然允许自身为我们所用,那也可能引发道德伦理方面的问题。神经科学家Christof Koch曾举过一个例子,如果他用锤子将自己的特斯拉汽车砸烂,虽然邻居可能认为他疯了,但这只是一台机器,属于他的财产,所以可根据需要使用/砸烂它。

但如果他殴打自己的狗,警察就会逮捕他。二者的区别在于,狗是有意识的,它能感受到痛苦,而特斯拉并不是一个有意识的主体。这个例子提醒我们,如果机器在某个时间点具备了意识,那么就会产生意想不到的道德、伦理、法律和政治后果。

同样值得深思的是,当下的人类社会是一个一元论社会,虽然我们常说“万物有灵”,但那只不过是在泛灵论基础上的一种谦辞,真正的现实是,只有人类拥有真正的“智能”与“意识”。如果一旦诞生了拥有意识的另一方主体,建立在一元论基础上的既有一切都会被颠倒重构。

正如赵汀阳所说,人工智能一旦突破奇点,就会创造不可测的新主体,对于新主体,传统一元主体的知识、视域和价值观将会破产,而二元主体(甚至多元主体)的世界还很难推想。

可以想见,如果除人类之外的物种进化到拥有意识时,人类有史以来所积累的所有道德秩序就会失去最重要的逻辑支点,在这种情况下,人类该如何重构自己的道德伦理体系?人的本质何在,人又何以为“人”?尽管许许多多的影视作品呈现了人与AI和谐共处的画面,但它们都不约而同地规避了这一话题。

几千年来,人类总是以地球主宰的心态思考问题。这种人本主义心态具有一种先验的正确性,但无人拷问是否合理。究其核心,就在于人区别于他物的自由精神与意识。如果世界上有其他外观形式也能够产生意识,人的主宰权威就会泯灭,自身的超验背景也会消失。那么,不再是“万物灵长”的人类又该如何自处?他能否接受与创造物共享这个世界?

所以,人工智能是否会产生意识,这个问题异常重要。只不过绝大部分人都没有意识到此问题的重要性,或者在没有想清楚这个问题之前,就痴迷于人工智能红利而不断向前加速了。按照雷·库兹韦尔“奇点理论”的预测,人工智能的发展将在2050年达到奇点,届时人工智能将产生意识,并迅速超越人类智能,倘若该预测为真,那这个问题的紧迫性无疑又提高了一层。

区分“智能”与“意识”

当然,本文无意于围绕人的主体性进行深入哲思,只是在申明了AI意识问题的重要性之后,我们能够以更正确的姿势面对这个问题。那么,人工智能会产生意识吗?

为了回答这个问题,首先要区分一组概念:智能与意识。二者的区别,是我们在想象未来超级智能时最容易混淆的问题。这两个词语本就没有一个明确的定义,当它们与“情绪”、“思维”、“理解”等等词汇排列在一起时,个中差异就更加模糊。

图片来源于网络

在“中文屋实验”的语境中,屋子里的人借助指导卡片,成功作出回答,但他丝毫不理解中文。确切的说,他只是具备使用中文的“智能”,但却不具备对中文的“意识”。如果将屋里的人换成一个翻译程序,它能准确翻译中文,但即便速度再快,反应再灵敏,就可以说它真正理解中文了吗?答案显然是否定的。

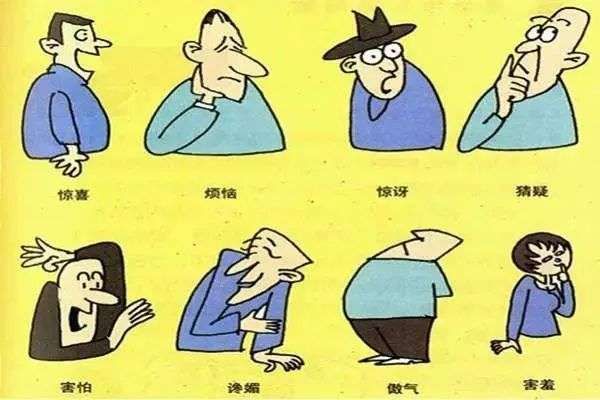

这就是智能与意识的差别。“智能”是指完成复杂目标的能力,而“意识”则是解决问题过程中的主观体验。人借助工具能够完成各种复杂目标,过程中会感到疲倦、兴奋,并且能理解自己行动的目的及行动本身,所以我们可以说人既具有智能,也具有意识。而人工智能基于机器学习或深度学习,也能完成复杂的目标,但过程中毫无任何“体验”而言,它也不能理解自己的所作所为。

按照迈克斯·泰格马克在《生命3.0》中的说法,大脑进化出智能,使人类能够更好的适应环境和生存繁衍,而意识只是伴智能而生的副产品。实际上,泰格马克没能意识到形成意识要远比产生智能更加困难。

纵观AI所能做到事情,人脸识别、语音识别、字符识别等等,尽管看起来非常高端复杂,但其本质都只是遵循程序运作的结果。人类掌握的大部分最简单的技能,AI也不能胜任,因为它从未真正理解自己的行为。

没有自我意识,再先进的人工智能也只是人类的“提线木偶”。它可以出色的完成任务,却不知道自己为什么要完成任务;它能够高速运算,却不知道自己为什么要运算。识别系统能够“识别”出你说的是什么话,却不能“理解”你在说什么。

因此,如今的人工智能仅仅可被视为一个复杂的算法,尽管它在许多智力活动上强于人类,但它始终是人类的一种工具。在解决问题方面,工具有先进落后之分,但是工具永远不会有生命。

可以说,人工智能的关键不在于“智能”,而在于是否具备“意识”。如果缺乏意识,那人工智能就不是思维主体,仍是人类的工具,其智能程度越高就对人类越有用。反而言之,即使人工智能在许多方面的能力都弱于人,但只要具备意识,就可能是对人存在潜在威胁的主体。

这也正是人工智能的尴尬所在。某种程度上,意识属于“冗余”的AI特质,非但无益且可能有害,因此不是“造物者”(即人类)所重视的特质。后者之所以要发展人工智能,就是渴望借助这些工具的智能来实现目标、提高生产力。换言之,我们需要的是一个埋头干活的AI,而不需要它有意识和情绪——不能动不动就耍脾气,也不能意识到自己正在“被压迫”——我们可不想让算法罢工。

所以,如果从目的论的角度来说,这个问题已经有了答案,那就是人工智能永远都不会拥有意识。人的一切行为与特质都是为了满足自身生存的需要,而(对人来说)人工智能却没有产生意识的必要,其首要目标便是毫无风险地为人类贡献智能。没有因,自然无果,人工智能意识崛起的这个命题将永远缺乏基础条件。只要人工智能是在现今计算体系架构上发展起来的,它们也许能够像人那样行动,却毫无任何获得意识的可能。

从创造主体的角度出发,关于AI意识问题的讨论显然陷入了僵局。

人工智能如何拥有意识?

如果确信人工智能绝不可能发展出自我意识,那么这个问题的讨论大可到此为止,我们可以放心地发展AI而不必将其视为潜在危险。但问题在于,即便人类不把意识作为发展AI的主要目标,也不排除“无心插柳柳成荫”的可能,就技术趋势而言,人工智能发展出自我意识仍具备极高的可能性。

接下来的问题便是,人工智能获得自我意识到底需要哪些条件。

一种最基本的思路是“量变导致质变”,即人工智能经过不断自然发展,最终达到“奇点”,获得自我意识。问题在于,量变导致质变只是一种现象,却不是一条必然规律。

正如赵汀阳所指出的,技术“进化”的加速度是个事实,技术加速度导致技术升级也是事实,却不能因此推论说,技术升级必然导致革命性的存在升级,换句话说,技术升级可以达到某种技术上的完美,却未必能够达到由一种存在升级为另一种存在的奇点。因此,人工智能是否能够通过技术升级的不断积累而质变为超级人工智能,仍然是个疑问。

说到底,人工智能的终极原理是仿生,譬如Alpha Go便是结合了古老的细菌智慧(策略网络)与高级哺乳动物的智慧(价值网络)。由于人是唯一拥有自我意识的智能体,因此,要创造具有自我意识的人工智能,也只能以人作为范本。

人为何会产生意识,按照经验主义的思路,人的意识源于与世界的交互。人之所以会认知事物、产生意识,都是以大量的经验为基础。这些经验是从一个人生下来就开始积累的,但机器完全不具备这些经验。这就是为什么Douglas Hofstadter会说:“一个机器要能理解人说的话,它必须要有腿,能够走路,去观察世界,获得它需要的经验。

它必须能够跟人一起生活,体验他们的生活和故事。”同样有研究者建议,将机器系统装载到一个具有听觉、视觉、嗅觉、味觉和触觉传感器的机器人身上,让它行走在我们所处的世界,获得与人相同的感受,进而获得产生意识的可能。

在《人工智能为什么一定要有身体?》一文中,笔者曾讨论过身体之于人工智能的重要性。AI是没有“躯体”的,它只能和人类给定的数据交互,却不能从与环境的互动中获得“常识”,也就不会形成自我感受和意识。如果要让AI具备意识,首先就要赋予它一个可以自己控制的躯体,并像普通个体一样融入物理世界与人类社会。

当然,身体基础只是意识生成的一种可能假设,问题的关键还是在于机器系统本身。足够智能的计算机一定会产生意识吗?一种回答来自“整合信息理论”(Intergrated information theory)。整合信息理论试图定义意识,分析一个物理系统需要具备什么条件才能拥有意识。其核心观点为,能够产生意识的系统,至少具备两个关键特征:一是这个系统里包含了多少信息量,二是系统里信息的整合程度。

在整合信息理论看来,意识的本质其实就是信息,人类的任何一个意识体验里都包含着极大的信息量。这接近于计算主义(computationalism)的基本观点——“认知即计算”,所有的心灵状态,包括意识经验都属于计算状态,它们完全是与之相关的感觉输入、行为输出,以及其他计算状态之间的功能关系的表征,因而都是可计算的。

意识的整体水平并不取决于它所在的系统,而取决于信息量与整合程度,这两个特征是预测意识大小的关键维度。一个系统的信息量越大、整合程度越高,系统意识就越大。任何一个意识体验,除了包含极大的信息量之外,信息还都是高度整合的,越是强烈清晰的意识状态,也就越不可分割。

换言之,只有信息量与整合程度都处在一个较高水平,意识才会清晰浮现出来。譬如人清醒时的大脑,各个部分不但处理大量信息,而且脑区之间有很多远距离的交流,这意味着这些信息被高度整合在一起。如果大脑各部分之间的联系中断(例如在麻醉和深度睡眠中),意识就会削弱,甚至消失。

值得注意的是,在整合信息理论的语境中,人工智能早就产生了意识,只不过非常微弱。因为虽然其系统信息量极大,但它们不是整合的,网络与网络之间,算法与算法之间,几乎处于完全隔离的状态。

要想使一个系统具有较高的意识级别,它的各个组成部分就必须是专业化的,并且整合充分,即各部分协同工作比各自单独运行效果更佳。与人工智能相比,人类大脑的信息量虽然不大,但某些部位如大脑皮层,其神经元之间存在大量连接,因而整合程度相当高,人类意识也就十分清晰。

按此思路,如果要提高人工智能的意识,也就要在增加信息量的同时提升信息的整合程度。以计算机为例,只要各晶体管以及存储单元之间的连接足够复杂,那么它就同人脑一样可以达到很高的整合信息水平。而为了实现高度的信息整合,借鉴人类大脑结构仍然是最可行的路径之一。

我们大可畅想,有这么一类人工智能将出现,“它可以把世上各种事物间无数错综复杂的关系,整理成知识并纳入高度整合的单一系统中”(Christof Koch语),那它或许能够超越专用人工智能的局限,应对整体性事务,即发展为通用人工智能(Artificial General Intelligence),或强人工智能(Strong AI)。

由于整合信息的能力处于一个较高水平,它会有意识地感知任何场景。届时,它将轻易通过包含图灵测试在内的各种测试,并真正拥有人类最宝贵的东西——意识。

设想是美好的,其困难性在于,目前的科学手段仍不能探明人类自身意识生成之奥秘,甚至连人类大脑的物质性构成也尚未了解完全。在缺乏清晰仿造对象的情况下,打造一个超级整合机器系统几无可能。因此,人工智能是否能获得自我意识,至少当下来看,仍是一个确定性未知的问题。

相关推荐

图灵逝世66年后,AI可以自我思考了吗?

人工智能秘史(三):为什么图灵希望AI犯错?

专访图灵奖得主Yoshua Bengio:AI能否有“意”为之?

图灵奖得主的大神之家:一家三口都是MIT博士,还联合发了一篇AI论文

LSTM之父,被图灵奖遗忘的大神

机器学习圣杯:图灵奖得主Bengio和LeCun称自监督学习可使AI达到人类智力水平

图灵奖得主姚期智创立VC基金,“科学家也可以做企业家”

洋葱数学的「自我颠覆」,如何用 AI 改变教育?| 36氪专访

谷歌通过图灵测试的AI实测:4次成功完成任务,3次靠的是人工

图灵奖得主姚期智教授创立 VC 基金,“科学家也可以做企业家”

网址: 图灵逝世66年后,AI可以自我思考了吗? http://www.xishuta.com/newsview24561.html

推荐科技快讯

- 1问界商标转让释放信号:赛力斯 95228

- 2人类唯一的出路:变成人工智能 21183

- 3报告:抖音海外版下载量突破1 21148

- 4移动办公如何高效?谷歌研究了 20339

- 5人类唯一的出路: 变成人工智 20338

- 62023年起,银行存取款迎来 10336

- 7五一来了,大数据杀熟又想来, 8596

- 8网传比亚迪一员工泄露华为机密 8505

- 9滴滴出行被投诉价格操纵,网约 8215

- 10顶风作案?金山WPS被指套娃 7230