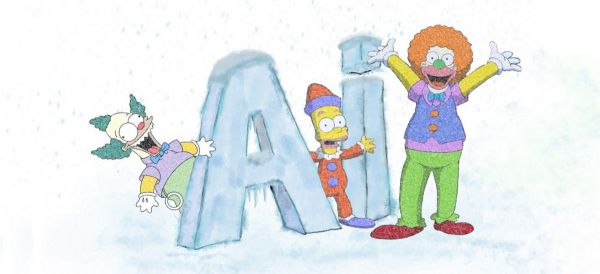

“AI 寒冬论”作者再发声:人工智能行业就是一个马戏团

神译局是36氪旗下编译团队,关注科技、商业、职场、生活等领域,重点介绍国外的新技术、新观点、新风向。

编者按:时隔半年,“AI寒冬论”作者Piekniewski再度发声。这次,他把矛头对准了OpenAI和特斯拉,认为它们的所做所为,无异于马戏团中的小丑。在他看来,我们正处于“临死反扑”阶段。在这个阶段,那些最有可能失去的人,正在拿出他们能想到的最离谱的信心,来欺骗更天真的人给他们钱。文章原标题为AI Circus, Mid 2019 Update,由36氪神译局编译,希望能够为你带来启发。

大约一年前,我发布了一篇“人工智能的冬天即将到来”的帖子,引发了病毒式的传播。就像我承诺的那样,我会定期发布文章,对其中的观点进行更新。

6个月前,我发布了一篇,现在是时候发布新的内容了。虽然这一年来发生了很多事情,但没有一件事情能够改变我原有的想法:人工智能泡沫正在破裂。

正如每一次泡沫的破裂的情况那样,我们正处于“临死反扑”阶段。在这个阶段,那些最有可能失去的人,正在拿出他们能想到的最离谱的信心,来欺骗更天真的人给他们钱。

现在,让我们回顾一下到底发生了什么。

先说一些严肃的事情

首先,我们来看一些比较严肃的事情。深度学习的三位创立者杰弗里·辛顿(Geoffrey Hinton)、约书亚·本吉奥(Yoshua Bengio)和杨立昆(Yann Lecun)获得了图灵奖,这是计算机科学领域最具声望的奖项。

如果你认为我会以某种方式质疑这个判断,你会感到失望,我认为深度学习值得获得图灵奖。

在我个人看来,于尔根·施密德胡伯(Jürgen Schmidhuber)不在其列,给人留下了一点不好的印象。虽然我认为,他有些时候让人有些尴尬,但是他对深度学习领域的贡献是不可否认的。

顺便说一句,这些家伙都相当安静,辛顿最终有了自己的Twitter账号。但他还是一直保持谦虚的风格,并没有发表任何我认为不真实或过于热情的推文。杨立昆偶尔会宣传他的研究,但也没什么特别的。 同样,本吉奥在社交媒体上也并不活跃。

我最喜欢的其他人也很安静。去年秋天,李飞飞离开谷歌云,回到了她在斯坦福大学的工作岗位。吴恩达异乎寻常的安静:也许是因为他最近有了一个孩子——我真诚地祝贺他和他的妻子,两个月前我自己也有了一个孩子,我知道这是多么快乐的事情,但我也意识到,一个孩子可能会妨碍他每周工作90个小时,并导致人工智能奇点不可避免的推迟。

在过去的几个月里,人工智能领域发生了一系列让人啼笑皆非的事件,这些事件是围绕着Open AI和特斯拉展开的。

人工智能圈,就是一个马戏团

OpenAI,一个非营利组织,使命是解决通用人工智能(AGI)问题,并确保他们的发现对公众开放,而不是被一些心存恶意的公司拿去牟利。

今年2月份,他们发布了一个文本生成模型GPT-2。 令所有人惊讶的是,他们并没有开源公布,理由是担心可能会被误用,这在研究人员和人工智能圈中引发了非常大的争议。

从这个事件来看,我不确定这些家伙是如何声称他们是“Open”的。但他们并没有发布关于这个模型的关键部分。顺便说一句,在我看来,在他们发布完整的模型之前,GPT-2也可以用众包平台来实现。

(译者注:根据AI媒体量子位报道,来自慕尼黑工业大学的Connor Leahy同学,在两个月的时间里,付出了200个小时的时间,花费了大约6000人民币,复现了GPT-2项目。)

尽管 GPT-2生成的文本看起来很合理,但我不确定人们如何能滥用它来生成假新闻或垃圾邮件,或者真正地将其用于娱乐以外的任何事情。

但无论如何,这个名为“OpenAI”的组织,显然已经不再开放了。所谓的非营利机构,也提出了一个如何盈利的想法。

是个,这个本应该类似于“十九世纪的普罗米修斯”的组织,应该由不带偏见和公正的研究人员组成的修道院,努力为整个人类提供人工智能的火焰的组织,现在已经不再开放,背后实际上却是为了盈利。

但是,他们还仍然坚持这些宏伟的使命,因为利润将被限制——每个投资者最多只能获得100倍的回报。现在,我能想到让这一切发生的背后原因是,他们不能再以非营利组织的身份筹集资金了。

让我们暂时抛开这样的一个事实:到目前为止,这家公司的利润几乎为零,而且它的结构不像任何以及有想象力的创业公司(而是像一个研究实验室)。

山姆·阿尔特曼(Sam Altman),在硅谷人脉非常广泛,曾经负责经营创业孵化器Y Combinator,现在是OpenAI的首席执行官。

在采访他的一篇文章中,我发现了一些有关“炒作周期”的精彩内容。我希望大家能够去看完整的访谈,在这里,我只引用其中较为精彩的部分:

例如,当被问及OpenAI计划如何赚钱时,阿尔特曼回答说,“诚实的回答是,我们不知道。我们从来没有赚过钱。我们目前没有创收的计划。我们不知道我们将如何产生收入。”

阿尔特曼继续说,“我们已经向投资者做出了一个承诺,‘一旦我们建立了一个通用智能系统,基本上我们会要求它找出一种方法,为你带来投资回报。’”

当观众爆发出一阵笑声时 ,阿尔特曼自己说,这听起来像是《硅谷》电视剧中的一集,但他补充说,“你可以笑。没关系。但这是我真正相信的。”

是的。我不知道该补充些什么。我确信,计算出如何产生收入,应该比搞清楚通用人工智能要容易得多。简而言之,我的主张是:我相信我们可以建立通用人工智能,尽管我没有任何证据,但我确实坚信,如果你给我们数十亿美元,我们可以做到。

我希望我也能相信这一点,但不幸的是我不相信,我认为OpenAI 已经变成了一个彻头彻尾的骗局。通过查看这些OpenAI员工的推文,这个判断得到了进一步的强化,例如:

沃伊切赫·扎伦巴(Wojciech Zaremba),在纽约大学(NYU)时曾非常理性(我在2015年与他通过几封电子邮件) ,现在却成了一名“信徒”。

沃伊切赫·扎伦巴(Wojciech Zaremba),在纽约大学(NYU)时曾非常理性(我在2015年与他通过几封电子邮件) ,现在却成了一名“信徒”。

上面的这条推文中,有太多的错误。甚至很难想象,这是对数据和现实有所理解,并且作为一名科学家说出来的话。

但是,这些看似聪明的人,却相信旧金山海湾地区的回音室(echo chamber)的信息,而且还有成千上万的年轻一代在盲目地追随它。

具体地说:上面描述的方法(我甚至不确定“方法”到底是什么意思),可能在数百万种情况下不起作用(而且有大量证据表明它确实不起作用)。

一个潜在的原因是:即使他们有所有的数据,也很可能是有偏见的,因为人们在驾驶的时候,会明确地避免边缘情况。 另一个潜在的原因是:边缘情况是一个非常稀疏的集合,统计上会被“非边缘情况”所淹没。

深度学习的过程中,会对所有数据点进行全面损失优化,这可能会彻底消除边缘情况。而每个边缘情况,可能需要自己的数据再平衡/损失函数调优。

另一个理由是,即使有50万辆特斯拉在路上行驶,即使他们收集了所有的驾驶数据(事实上他们没有) ,如果边缘情况是长尾和不稳定的,也很难覆盖所有的边缘情况。

(另一种想象的方式是,你可以根据历史股市数据训练一个模型,用它来指导你炒股,你会比你能想象得更快破产)。

第四,人类在路上的边缘情况与自动驾驶汽车在路上的边缘情况不同,而且确实是不断变化的。

另一个或许是最不明显的原因,他们正在使用的特定深度网络,可能没有足够的表达能力来表达它所需要表达的内容(即使假设他们拥有训练它所需要的所有数据)。

感知器在80年代就已经为人所知,它是通用的近似器,然而它需要非常具体的微调结构,被称为convnet,同时还需要一系列的技巧,来提高收敛性和足够数量的可训练参数来求解ImageNet。

即使在今天,你也不能只用通用的连接多层的感知器,并期望它学习你要求它做的任何任务。即使你有大量的数据,也需要大量的调优和元参数搜索,才能找到解决问题的方法。

最后,即使在原则上这一切都是可行的,我们也不清楚,在特斯拉内置的计算机的限制下是否可以实现。

在自动驾驶领域的其他玩家,都在汽车里塞满了激光雷达。虽然昂贵,但解决了大多数什么特斯拉试图通过人工智能解决的问题。

根据我们的数据,已经成熟的游戏GPU,提供了比特斯拉最新的硬件更多的计算能力。很显然,还没有任何一家公司接近完全自动驾驶。

这就是为什么特斯拉的自动驾驶方法不一定会奏效的几个原因。每一位称职的数据科学家,哪怕在喝了一瓶伏特加后,也能够直接背诵出来。

说到特斯拉的“自动驾驶日”(autonomy day),他们给出了一些相当大胆的声明,比如特斯拉将在2020年拥有100万辆自动驾驶的出租车,在我看来,这种可能性为零。

我已经表达了我对伊隆·马斯克(Elon Musk)和他疯狂的承诺和想法的看法,我不想在这个帖子上花太多篇幅去说。(坦白地说,我不想吸引特斯拉粉丝的关注,我希望他们生活在自己的幻想世界里)。

让我们从另一个角度来关注特斯拉吧。

今年早些时候发生了一些有趣的事情:麻省理工学院的研究科学家莱克斯·弗里德曼(Lex Fridman)发布了一项研究,他在研究中声称(与几位合著者一起) ,使用自动驾驶仪(AutoPilot )的司机仍然保持警惕和专注,这与之前大量研究文献的观点相悖。

这项研究的发表,本身就充满了争议——首先,弗里德曼邀请记者报道这项即将发布的研究。

一些科学家,比如英伟达的研究主管阿尼玛·阿南德库马尔(Anima Anandkumar) ,试图鼓励他将这项研究提交给同行评议。

为此,弗里德曼在Twitter上屏蔽了她,甚至只要有人对他的方法提出了哪怕一丁点的批评,他都会把对方屏蔽。

这项研究被报道之后(让我们强调一下: 一项未经同行评审的研究),弗里德曼(他是一个相当公开的特斯拉粉丝)就在Twitter上表示,特斯拉和马斯克都与这项研究(对特斯拉有利)没有任何关系,随后他删除了那些推文,然后在Twitter上发了一些关于诚信的东西(也许是因为他觉得这项研究受到了质疑)。

两周后,他被邀请与伊隆·马斯克一起参加播客,然后又受邀参加另外一个播客。他利用这两个场合无耻地推销自己,这是他一直在做的事情。

我不会在这里谈论论文本身的细节,我推荐大家去看看杜克大学的人机交互教授米西·卡明斯(Duke Cummings)的一个访谈播客,他谈到了很多关于麻省理工学院研究中的细节问题,并指出这项研究是有缺陷的。

鉴于上述所有的事情,我正式提名莱克斯·弗里德曼为2019年人工智能领域最可笑的小丑候选人。尽管现在2019年还不到一半,比赛还没有结束,但我认为他获胜的机会还是很大的。

继续说回特斯拉,美国国家运输安全委员会(NTSB)发布了他们在佛罗里达致命车祸的初步报告表明 ,事故确实与特斯拉的自动驾驶仪有关。

这至少是第四起有记录的自动驾驶致死事故。虽然这可能不是很大的数字,但应该指出的是,卡迪拉克也有一个类似的系统,被称为超级巡航系统(ADAS),截至本文撰写时,还没有发生过任何一起死亡事故。

二者微妙的区别在于,超级巡航系统有一个司机监控系统,可以确保司机一直保持警惕,而特斯拉没有,这一切都是弗里德曼的研究非常那什么的证据。

其他方面,自从我上一次更新文章以来,又有两家人工智能/机器人公司倒闭了——Jibo和Anki。

对我个人来说,Jibo是一个特别有趣的案例,因为当我看到他们的Indiegogo活动时,就知道它的结局如何了。

这个项目由麻省理工学院的研究员辛西娅·布瑞西尔(Cynthia Breazeal)创立,一经亮相便立即获得了追捧,只是承诺了一些在当时甚至现在都不可能实现的功能,就筹集了大约7200万美元。

我不知道麻省理工现在到底发生了什么。

首先,辛西娅·布瑞西尔——一位自称是机器人专家的人——承诺了Jibo所有的奇迹,显然她并没有意识到,其中大多数奇迹甚至还没有出现在图纸上。

然后,莱克斯·弗里德曼就把自己变成了一个小丑(他只是一个被雇佣的研究科学家,不是麻省理工学院的毕业生)。

除此之外,据报道,安大略省政府决定削减人工智能方面的开支,其中包括图灵奖得主Hinton矢量研究所的开支。这在人工智能界引起了相当大的愤怒。

这真的只是即将到来的寒冬带来的第一波严重冻伤,我建议所有那些被冻伤的人,去找些保暖的衣服,或者换个工作。

结语

这就是2019年年中的人工智能领域的状况。正如我所预料的那样,这个领域变得越来越荒谬,本质上就是一场小丑表演。

我想,我们很快就会知道,所有的人工智能泡沫实际上只是一个笑话,从一开始,我就在这个博客上说过这些话。

原文链接:https://blog.piekniewski.info/2019/05/30/ai-circus-mid-2019-update/

译者:尺度。

相关推荐

“AI 寒冬论”作者再发声:人工智能行业就是一个马戏团

为AI清君侧:为什么鼓吹“寒冬论”的都是AI学者?

一个AI创业者看《投资人逃离人工智能》

停演,裁员,申请破产,太阳马戏团欢乐不再

倒下的太阳马戏团,与它的20年辉煌创新史

波士顿动力机器狗签约世界第一马戏团,太阳马戏团确认Spot将出演

2020年,人工智能的盛世,创业公司的寒冬

四小龙集体冲刺上市,AI的寒冬结束了?

瑞为:非著名AI企业的寒冬生存法则

硅谷顶级VC再发声:解决AI商业化困境?先来驯服这条长尾

网址: “AI 寒冬论”作者再发声:人工智能行业就是一个马戏团 http://www.xishuta.com/newsview6038.html

推荐科技快讯

- 1问界商标转让释放信号:赛力斯 95228

- 2人类唯一的出路:变成人工智能 21183

- 3报告:抖音海外版下载量突破1 21148

- 4移动办公如何高效?谷歌研究了 20339

- 5人类唯一的出路: 变成人工智 20338

- 62023年起,银行存取款迎来 10336

- 7五一来了,大数据杀熟又想来, 8596

- 8网传比亚迪一员工泄露华为机密 8505

- 9滴滴出行被投诉价格操纵,网约 8215

- 10顶风作案?金山WPS被指套娃 7230