英伟达:CPU已落伍,用GPU训练大语言模型成本可降低96%

IT之家 5 月 29 日消息,根据英伟达在 2023 年台北电脑展会上的演讲,该公司宣称其 GPU 可以大幅降低训练大型语言模型(LLM)的成本和耗能。

英伟达首席执行官黄仁勋在演讲中,向 CPU 行业发起了挑战,他认为生成式人工智能和加速计算是未来计算的方向。他宣布传统的摩尔定律已经过时,未来的性能提升将主要来自生成式人工智能和基于加速计算的方法。

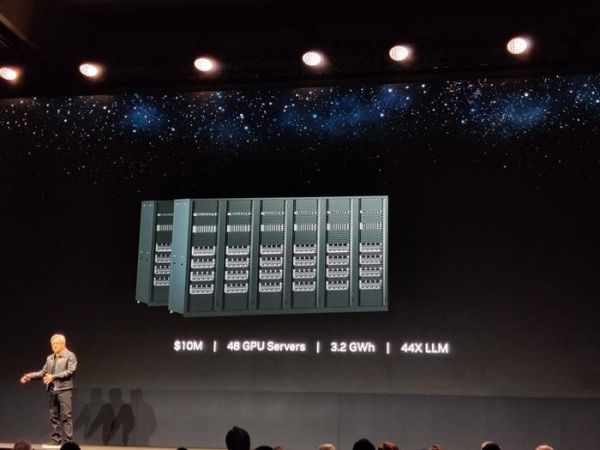

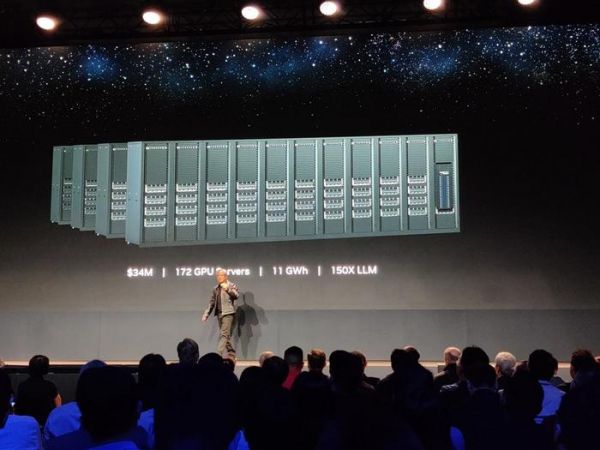

英伟达在展会上展示了一份 LLM 的总体拥有成本(Total Cost of Ownership,TCO)分析:首先,他们计算了训练一个 LLM 所需的 960 个 CPU 组成的服务器集群的完整成本(包括网络、机箱、互连等所有设备),发现这需要花费约 1000 万美元(IT之家备注:当前约 7070 万元人民币),并消耗 11 千兆瓦时的电力。

相比之下,如果保持成本不变,购买一个价值 1000 万美元的 GPU 集群,可以在同样的成本和更少的电力消耗(3.2 千兆瓦时)下训练 44 个 LLM。如果转而保持电力消耗不变,那么可以通过 GPU 集群实现 150 倍的加速,以 11 千兆瓦时的电力消耗训练 150 个 LLM,但这需要花费 3400 万美元,此外这个集群的占地面积比 CPU 集群小得多。最后,如果只想训练一个 LLM,那么只需要一个价值 40 万美元、消耗 0.13 千兆瓦时电力的 GPU 服务器就可以了。

英伟达所要表达的意思是,相比 CPU 服务器,客户可以以 4% 的成本和 1.2% 的电力消耗来训练一个 LLM,这是一个巨大的成本节省。

发布于:山东

相关推荐

英伟达:CPU已落伍,用GPU训练大语言模型成本可降低96%

英伟达帝国的一道裂缝

为什么科技巨头纷纷选择英伟达AI,而GPU同样出色的AMD“无人问津”?

英伟达发布首个 CPU,集齐“三芯”叫板英特尔?

叫板英特尔,英伟达发布首个 CPU,集齐“三芯”!

教主黄仁勋亮相GTC China:英伟达已售出15亿块GPU,重磅发布TensorRT 7

十年磨一剑,英伟达能否掌控人工智能的未来?

揭竿而起,他们都想干掉英伟达

大模型热到芯片暴涨,阿里百度成了英伟达的打工仔

英伟达的未来,不只是GPU

网址: 英伟达:CPU已落伍,用GPU训练大语言模型成本可降低96% http://www.xishuta.com/newsview76693.html

推荐科技快讯

- 1问界商标转让释放信号:赛力斯 95263

- 2人类唯一的出路:变成人工智能 21515

- 3报告:抖音海外版下载量突破1 21493

- 4移动办公如何高效?谷歌研究了 20661

- 5人类唯一的出路: 变成人工智 20652

- 62023年起,银行存取款迎来 10369

- 7五一来了,大数据杀熟又想来, 8890

- 8网传比亚迪一员工泄露华为机密 8561

- 9滴滴出行被投诉价格操纵,网约 8513

- 10顶风作案?金山WPS被指套娃 7255